NEXTAGE Open in Singapore revisited: both hands assembly using camera imageNEXTAGE Open in シンガポールその2:画像処理と両手を使った物品組み立て

ROS が普及したことで,ロボット開発者の間である種の共通言語となりつつあると言っても過言ではありません.既に多くのロボットの可動実績があり,ユーザ数は10万人を超えるとも言われ (2015年 ROSCon より),ロボットのシステム構築において着実に情報が蓄積されており,それを元に更に益々ユーザ層が厚くなるといった良い循環ができています.

とはいえロボット毎のハードウェアの違いを基にした差異は避けられないもの.同じロボットを扱う開発者間の情報は貴重でしょう.

弊社がソフトウェアのメンテナンスを中心となって行わせて頂いている NEXTAGE Open (カワダロボティクス社) も世界中にユーザがおり,私達も情報共有に微力ながら貢献しています.NEXTAGE Open の ROS 版ソフトウェアの利用に際して,議論はメーリングリストへ,御質問は github へどうぞ.

[github-issues username=”tork-a” repository=”rtmros_nextage” limit=”10″]

表.github 上で議論中のチケット一覧

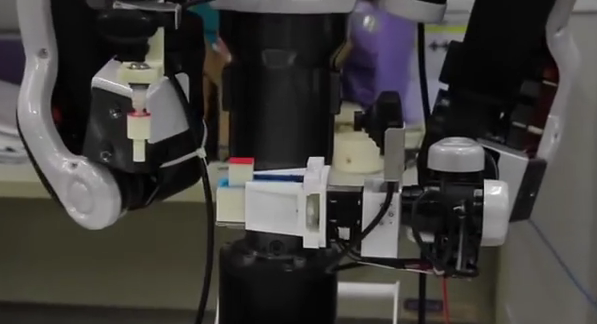

今日は,先日もお伝えしたシンガポールの Nanyang Technological University (NTU) の研究者が公開している,NEXTAGE Open の動画を紹介します.今回はカメラからの入力を元に幾つかの Pick&Place を行っているようです.今のところこれら動画中のアプリケーションソフトウェアは公開されていないようですが,御興味があれば動画サイトのコメント機能でコメントで開発者に連絡してみると良いでしょう.

One of its many achievements as ROS being used for more and more robots is that it’s becoming a common language for the robot developers. One estimate (which is actually made by the CEO at OSRF, the maintenance organization of ROS) indicates that the userbase has now well reached 100,000 at the time of 2015 ROSCon. With vast amount of userbase with accumulated information for robot system development, we’re seeing a very successful lifecycle of ROS collectively expanding more info and users.

Still, flesh side of robots – hardware – inevitably differentiates the application level of development per robot, and therefore the conversation among the users of the same robots is valuable. For NEXTAGE Open (Kawada Robotics Inc.), the one that we TORK has been actively maintaining, there are a couple of active forums: discussion can be started at mailing-list and questions at its github.

[github-issues username=”tork-a” repository=”rtmros_nextage” limit=”10″]

Table. Current issues of NEXTAGE Open ROS software on github

Today we have a few videos from researchers from NTU (Nanyang Technological University) (there was one blog post before already) in Singapore that utilize vision input for pick & place application. Code for these app are likely not yet publicized but you can contact the researchers’ group by commenting on each video on the video sharing website.

著者について