2017年10月の名古屋 ROSワークショップ日程

10月は以下の日程でROSワークショップを行います.

- 10月10日(火)13:30~ (名古屋) ROSワークショップ初級編

10月20日(金)13:30~ (名古屋) ROSワークショップ初級編(日程が変更になりました)- 10月23日(月)13:30~ (名古屋) ROSワークショップ初級編

場所: COffice名古屋伏見 (伏見駅,名古屋広小路伏見中駒ビル5F)

ROSの初歩をスピーディに習得したい方,ROSの疑問点を解消したい方,中部地方の方の参加をお待ちしております.

もちろんこれまでどおり東京でもワークショップを開催しておりますので,お選びいただけます.

お申込みは以下より詳細をご確認の上,ページ内のお申込みリンクよりエントリをお願い致します.

また,ROSワークショップ中級編についても名古屋にて開催できるようになりました.ご要望があり次第,日程を調整いたしますのでメイルにてお問い合わせください.ただし,初級編を受講した方を対象としております.

上記以外での日程の調整,その他ご相談,開発委託,出張ワークショップ,カスタマイズワークショップも承っております.お気軽にご相談ください.

info[at]opensource-robotics.tokyo.jp

ROS + Snappy Ubuntu Core (4) : Raspberry Pi 3へのUbuntu Coreのインストール

前回はSnappyなROSパッケージの中身を見てみました.今回はより具体的な活用例としてRaspberry Pi 3へのUbuntu Coreのインストール方法を見ていきましょう.

このページの内容に従い,Raspberry Pi 3にUbuntu Coreをインストールしてみます.

以下の作業は,Ubuntu 16.04の環境で行いました.まず,Ubuntu Core imageにある,’Ubuntu Core 16 image for Raspberry Pi 3’のイメージファイルをダウンロードします.320MBありました.

つぎにこれをMicroSDカードにコピーします.手元の環境ではMicroSDカードをカードリーダに挿すと/dev/sdaとして認識されたので,

$ xzcat ubuntu-core-16-pi3.img.xz | sudo dd of=/dev/sda bs=32M $ sync

としました.

RaspberryPi3を先ほど作成したMicorSDカードで起動します.

最初の起動の際には,コンソールからのログインが必要なので,キーボードとディスプレイを接続しておきます.

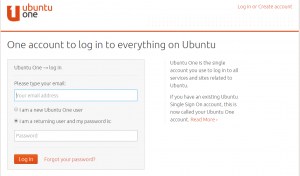

いきなり詰まってしまいました.login.ubuntu.comのアカウントのメールアドレスを入力せよ,と言われます.Ubuntu Coreの使用には,ubuntu.comのアカウント登録が必要のようです.インストールにはインターネット接続が前提なので,proxy環境などでは困りそうです.

別のPCからlogin.ubuntu.comにアクセスして,アカウントを作成します.

さらに,そのままだとssh keyが無いといわれます.login.ubuntu.comのsshのページでsshの公開鍵を設定しておく必要があるようです.この公開鍵に対応する秘密鍵による認証で,Raspberry Pi 3にsshでログインすることができます.

自分のマシンがUbuntuの場合,自分のマシン上で

$ ssh-keygen

とコマンドを打ち,パスワード等を設定します.~/.ssh/id_rsa.pubというファイルができるはずなので,その中身をコピーして,SSH Keysのフォームに貼り付けます.

SSH Keysのページでssh keyを設定したマシンからは,Raspberry Piにsshでログインできるようになります.usernameは,ubuntu.comで設定したユーザ名です.Raspberry Pi3のIPアドレスは,DHCPで取得され,コンソール画面に表示されています.

$ ssh username@192.168.0.10

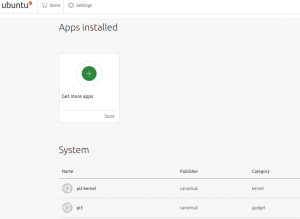

初期状態では,コマンドやアプリはほとんど入っていません.Ubuntuでお馴染みのaptやdpkgと言ったコマンドも使えません.今後,snappyパッケージを入れることで拡張していきますが,まずパッケージ一覧をWebブラウザで見るためのsnapwebパッケージをインストールしてみましょう.

$ sudo snap login username@example_domain.com $ sudo snap install snapweb $ snap list Name Version Rev Developer Notes core 16-2 1443 canonical - pi2-kernel 4.4.0-1030-3 22 canonical - pi3 16.04-0.5 6 canonical - snapweb 0.26-10 305 canonical -

Webブラウザで,”http://192.168.0.10:4200/”にアクセスしてみます.

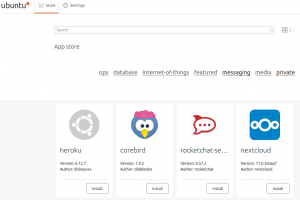

今インストールされているパッケージ一覧が見えたりします.ストアもあるようですが,

うーん,よくわかりませんが,ほとんどアプリは無いように見えます.

ROSワークショップ初級編を開催しました

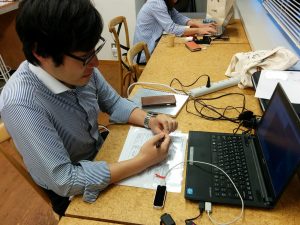

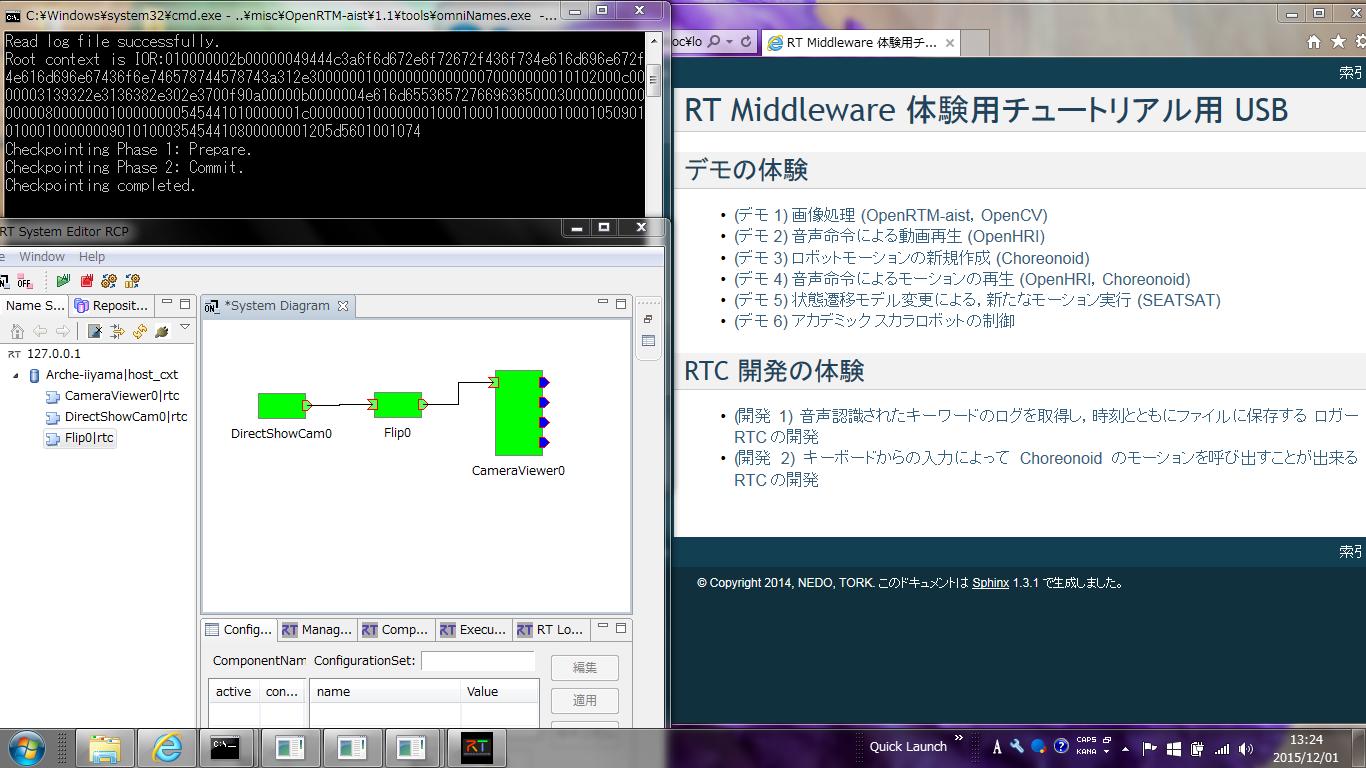

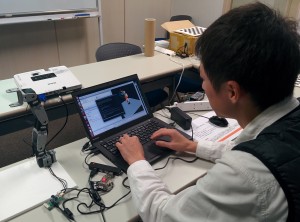

今回も有楽町にてROSワークショップ初級編を開催しました.

準備万端でご参加いただきサクサクと進みました.お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内でOSSを運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップ,その他OSSに関するご相談も承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

名古屋でのROSワークショップ,始めます!

これまで東京都内を中心に開催してきた弊社のROSワークショップですが,

2017年9月から,名古屋でもROSワークショップの開催を始めます!

(受付終了しました) 9月5日(火)13:30~ (名古屋) ROSワークショップ初級編

(受付終了しました) 9月15日(金)13:30~ (名古屋) ROSワークショップ初級編

場所: COffice名古屋伏見 (伏見駅,名古屋広小路伏見中駒ビル5F)

ROSの初歩をスピーディに習得したい方,ROSの疑問点を解消したい方,中部地方の方の参加をお待ちしております.

もちろんこれまでどおり東京でもワークショップを開催しておりますので,お選びいただけます.

お申込みは以下より詳細をご確認の上,ページ内のお申込みリンクよりエントリをお願い致します.

また,ROSワークショップ中級編についても名古屋にて開催できるようになりました.ご要望があり次第,日程を調整いたしますのでメイルにてお問い合わせください.ただし,初級編を受講した方を対象としております.

上記以外での日程の調整,その他ご相談,開発委託,出張ワークショップ,カスタマイズワークショップも承っております.お気軽にご相談ください.

info[at]opensource-robotics.tokyo.jp

2017年9月-10月のROSワークショップ日程

以下日程でROSワークショップを行います.

9月から名古屋でも開催いたします!

9月05日(火)13:30~ (名古屋)ROSワークショップ初級編

9月07日(木)13:30~ ROSワークショップ初級編

9月15日(金)13:30~ (名古屋)ROSワークショップ初級編

9月27日(水)13:30~ ROSワークショップ初級編

10月04日(水)13:30~ ROSワークショップ初級編

10月18日(水)13:30~ ROSワークショップ初級編

10月24日(火)13:30~ ROSワークショップ初級編

場所は都内・有楽町の会議室または名古屋市内での実施を予定しています.

中級編についてはご要望があり次第,日程を調整いたしますのでメイルにてお問い合わせください.

(初級編を受講した方を対象としております.中級マニピュレーション編のページまたは中級・自律移動編のページをご参照ください)

お申込みは以下より詳細をご確認の上,ページ内のお申込みリンクよりエントリをお願い致します.

上記以外での日程の調整,その他ご相談,開発委託,出張ワークショップ,カスタマイズワークショップも承っております.

お気軽にご相談ください.

info[at]opensource-robotics.tokyo.jp

ROS + Snappy Ubuntu Core (3) : SnappyなROSパッケージの中身

前回作成したSnappyのパッケージはどういう仕組みで動いているのでしょうか?

$ which talker-listener.listener /snap/bin/talker-listener.listener

$ ls -l /snap/bin/talker-listener.listener lrwxrwxrwx 1 root root 13 Jul 21 16:04 /snap/bin/talker-listener.listener -> /usr/bin/snap

となっています.これは,以下を実行するのと等価になるようです.

$ snap run talker-listener.listener

snapファイルは,単に/snap/に展開されるだけです.currentというのが最新版ですが,これはx1へのシンボリックリンクになっています.容易にロールバックできるようにするためなのでしょう.

$ ls -l /snap/talker-listener/ total 0 lrwxrwxrwx 1 root root 2 Jul 21 16:04 current -> x1 drwxrwxr-x 10 root root 222 Jul 21 16:00 x1

$ ls /snap/talker-listener/current bin command-roscore.wrapper etc meta snap var command-listener.wrapper command-talker.wrapper lib opt usr

command-listener.wrapperというのが目に付きます.中身を見ると,

#!/bin/sh

export PATH="$SNAP/usr/sbin:$SNAP/usr/bin:$SNAP/sbin:$SNAP/bin:$PATH"

export LD_LIBRARY_PATH="$LD_LIBRARY_PATH:$SNAP/lib:$SNAP/usr/lib:$SNAP/lib/x86_64-linux-gnu:$SNAP/usr/lib/x86_64-linux-gnu"

export ROS_MASTER_URI=http://localhost:11311

export ROS_HOME=${SNAP_USER_DATA:-/tmp}/ros

export LC_ALL=C.UTF-8

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:$SNAP/lib:$SNAP/usr/lib:$SNAP/lib/x86_64-linux-gnu:$SNAP/usr/lib/x86_64-linux-gnu

export PYTHONPATH=$SNAP/usr/lib/python2.7/dist-packages:$PYTHONPATH

export PATH=$PATH:$SNAP/usr/bin

# Shell quote arbitrary string by replacing every occurrence of '

# with '\'', then put ' at the beginning and end of the string.

# Prepare yourself, fun regex ahead.

quote()

{

for i; do

printf %s\\n "$i" | sed "s/'/'\\\\''/g;1s/^/'/;\$s/\$/' \\\\/"

done

echo " "

}

BACKUP_ARGS=$(quote "$@")

set --

if [ -f $SNAP/opt/ros/kinetic/setup.sh ]; then

_CATKIN_SETUP_DIR=$SNAP/opt/ros/kinetic . $SNAP/opt/ros/kinetic/setup.sh

fi

eval "set -- $BACKUP_ARGS"

export LD_LIBRARY_PATH="$SNAP/opt/ros/kinetic/lib:$SNAP/usr/lib:$SNAP/usr/lib/x86_64-linux-gnu:$LD_LIBRARY_PATH"

export LD_LIBRARY_PATH=$SNAP_LIBRARY_PATH:$LD_LIBRARY_PATH

exec "rosrun" roscpp_tutorials listener "$@"

となっており,ROSの環境設定などはこのラッパーファイルで行われた上で,コマンドが実行されるようです.つまり,いつもROSでやっているような”source setup.bash”などは必要ないことになります.楽になりそうですね.

snapパッケージにはほかに何が含まれているのでしょうか.

$ tree -L 3 -d /snap/talker-listener/current/

/snap/talker-listener/current/

├── bin

├── etc

│ ├── ca-certificates

│ │ └── update.d

│ ├── dpkg

│ │ └── dpkg.cfg.d

│ ├── emacs

│ │ └── site-start.d

│ ├── gss

│ │ └── mech.d

│ ├── ldap

│ ├── openmpi

│ ├── perl

│ │ ├── CPAN

│ │ └── Net

│ ├── python2.7

│ ├── python3.5

│ ├── sgml

│ ├── ssl

│ │ ├── certs

│ │ └── private

│ ├── systemd

│ │ └── system

│ └── xml

├── lib

│ └── x86_64-linux-gnu

├── meta

│ └── gui

├── opt

│ └── ros

│ └── kinetic

├── snap

├── usr

│ ├── bin

│ ├── include

│ │ ├── apr-1.0

│ │ ├── arpa

│ │ ├── asm-generic

│ │ ├── boost

│ │ ├── c++

│ │ ├── console_bridge

│ │ ├── drm

│ │ ├── gtest

│ │ ├── hwloc

│ │ ├── infiniband

│ │ ├── libltdl

│ │ ├── linux

│ │ ├── log4cxx

│ │ ├── misc

│ │ ├── mtd

│ │ ├── net

│ │ ├── netash

│ │ ├── netatalk

│ │ ├── netax25

│ │ ├── neteconet

│ │ ├── netinet

│ │ ├── netipx

│ │ ├── netiucv

│ │ ├── netpacket

│ │ ├── netrom

│ │ ├── netrose

│ │ ├── nfs

│ │ ├── numpy -> ../lib/python2.7/dist-packages/numpy/core/include/numpy

│ │ ├── openmpi -> ../lib/openmpi/include

│ │ ├── protocols

│ │ ├── python2.7

│ │ ├── rdma

│ │ ├── rpc

│ │ ├── rpcsvc

│ │ ├── scsi

│ │ ├── sound

│ │ ├── uapi

│ │ ├── uuid

│ │ ├── video

│ │ ├── x86_64-linux-gnu

│ │ └── xen

│ ├── lib

│ │ ├── compat-ld

│ │ ├── dpkg

│ │ ├── emacsen-common

│ │ ├── gcc

│ │ ├── gold-ld

│ │ ├── lapack

│ │ ├── ldscripts

│ │ ├── libblas

│ │ ├── mime

│ │ ├── openmpi

│ │ ├── pkgconfig

│ │ ├── python2.7

│ │ ├── python3

│ │ ├── python3.5

│ │ ├── sasl2

│ │ ├── sbcl

│ │ ├── ssl

│ │ ├── valgrind

│ │ └── x86_64-linux-gnu

│ ├── sbin

│ ├── share

│ │ ├── aclocal

│ │ ├── applications

│ │ ├── apps

│ │ ├── apr-1.0

│ │ ├── bash-completion

│ │ ├── binfmts

│ │ ├── boostbook

│ │ ├── boost-build

│ │ ├── bug

│ │ ├── ca-certificates

│ │ ├── cmake-3.5

│ │ ├── debhelper

│ │ ├── dh-python

│ │ ├── distro-info

│ │ ├── doc

│ │ ├── doc-base

│ │ ├── docutils

│ │ ├── dpkg

│ │ ├── emacs

│ │ ├── glib-2.0

│ │ ├── icu

│ │ ├── libtool

│ │ ├── lintian

│ │ ├── man

│ │ ├── mime

│ │ ├── mpi-default-dev

│ │ ├── numpy

│ │ ├── openmpi

│ │ ├── perl

│ │ ├── perl5

│ │ ├── pixmaps

│ │ ├── pkgconfig

│ │ ├── pyshared

│ │ ├── python

│ │ ├── python3

│ │ ├── sgml

│ │ ├── sgml-base

│ │ ├── xml

│ │ └── xml-core

│ └── src

│ └── gtest

└── var

└── lib

├── sgml-base

├── systemd

└── xml-core

144 directories

ワオ! talker-listenerのsnapパッケージには,ROSはもちろん,必要なLinuxシステムのディレクトリ構造がまるごと含まれています.ちょっと無駄な気がしますね…しかし,これがdockerなどで最近の流行りの,アプリごとに1つのコンテナを持つ(コンテナ仮想化),というやり方なのですね.

ちなみに,生成されたsnapファイルは,

$ ls -sh talker-listener_0.1_amd64.snap 154M talker-listener_0.1_amd64.snap

なんと154Mbyteもあります.こんなに大きくて,パッケージが増えた時には大丈夫なんでしょうか…どう見ても必要のないファイルがパッケージにたくさん含まれているので,このへんはおそらく解決する方法があるのでしょう.

次回は,より具体的なSnappyの活用例としてRaspberry Pi 3へのUbuntu Coreのインストール方法を見ていきましょう.

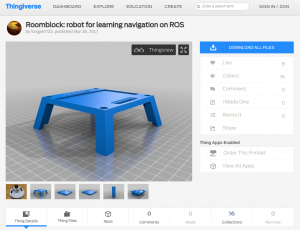

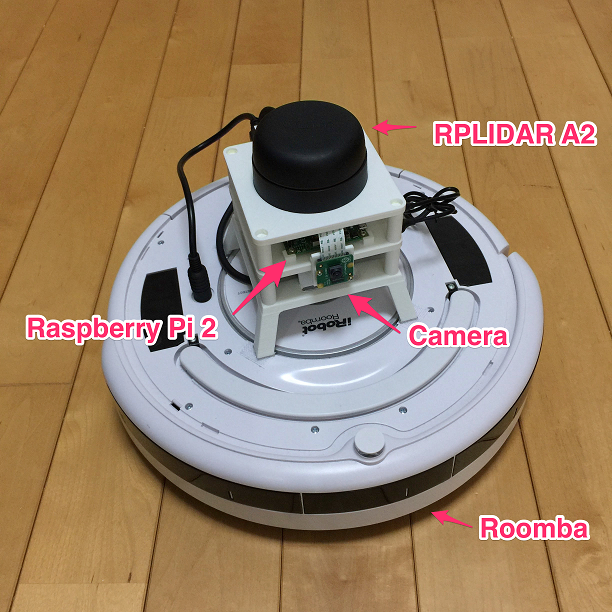

Roomblock(5): 3Dプリンタで出力可能なフレーム構造

前回までにルンバ,ラズベリーパイ,モバイルバッテリ,そしてレーザー距離センサといったRoomblockの部品を紹介しました.これらをルンバの上に載せるための,3Dプリンタで出力できる構造材を紹介します.

棚のような構造で,1番下の段にモバイルバッテリ,2番目の段にラズベリーパイ,1番上の段にRPLIDAR A2を載せます.動作中にモバイルバッテリが落ちてしまうことがあるので,1番下の段にはバッテリー固定用のベルトがつけられるようになっています.

部品をブロックのように交換したり追加したりして,機能を拡張することを狙っているので,”Roomblock”と名付けました.安直ですね.ラズベリーパイ用のボードカメラを固定するための部品も追加しました.

ルンバとフレーム部分はベルクロテープで固定されているので,取り外しも簡単です.

この構造材は,比較的安価な3Dプリンタでも出力できるサイズで設計されています.確認には UP! plus2を使いましたが,ワークエリアが15cm x 15cm程度の3Dプリンタであれば,大抵の機種で出力できると思います.3Dデータ(STLファイル)は,Thingiverseからダウンロードすることができます.

Roomblockの詳細な作り方については,Instructablesで公開しています.ただし当社は,これらの内容によって生じるいかなる損害についても責任を負いません.興味がわいた方はあくまで自己責任で,チャレンジしてくださいね.

ROSワークショップ初級編を開催しました

本日2017年8月8日,おかげさまで TORK は設立4周年を迎えました.

皆様,いつもありがとうございます!

これからも,お客様のご要望に応え,産業・学術界でのオープンソースロボティクスの進展に寄与できるよう,より一層努力して参ります.

—

今回も有楽町にてROSワークショップ初級編を開催しました.

小さな疑問点にも都度お答えしながらの密度の高いワークショップとなりました.お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内でOSSを運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップ,その他OSSに関するご相談も承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROSワークショップ初級編を開催しました

今回も有楽町の会議室にてROSワークショップ初級編を開催しました.

参加者の方が検討中のシステムについてのご相談もお受けしました.お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップ,その他OSSに関するご相談も承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS + Snappy Ubuntu Core (2) : SnappyなROSパッケージを作ってみよう

前回はUbuntu Coreについて紹介しましたが,いわゆる”Snappyな”パッケージシステムは,Ubuntu Coreをインストールしなくても試すことができます.Ubuntu CoreはあくまでSnappyをパッケージシステムとして使っているにすぎません.今回は,通常のUbuntuの上で,”Snappyな”ROSパッケージを作ってみようと思います.

SnappyなROSパッケージの作り方のチュートリアルは,ここにあります.とりあえずこの通りに従ってみましょう.

ただし,これをやる前に,Snapcraft Tourのチュートリアルを一通り読むことをお勧めします.

以下の手順は,Ubuntu 16.04 + ROS Kineticで試したものです.

まず,SnappyのパッケージングツールであるSnapcraftをインストールします.

$ sudo apt install snapcraft

SnappyパッケージにするためのROSパッケージが必要ですが,自分でコードを打ち込むのはめんどくさいので,githubからros_tutorialのソースコードをcloneします.

$ mkdir -p catkin_ws/src $ cd ~/catkin_ws/src $ git clone https://github.com/ros/ros_tutorials.git

snapcraftで初期化します.

$ cd ~/catkin_ws $ snapcraft init

snapというディレクトリができて,その下にsnapcraft.yamlというファイルができます.このファイルを,roscpp_tutorialsの中のバイナリが含まれるように,書き換えます.書き換え方はチュートリアルに解説があるので参照してみてください.雰囲気でわかると思います.

さて,いよいよパッケージを作成します.

$ cd ~/catkin_ws $ snapcraft

なにやらネットワークからいろいろとダウンロードし始めました…snapcraftはcatkinワークスペースを理解できるので,package.xmlを見て,rosdepで必要なパッケージをダウンロードしているのです. 「必要なROSのパッケージは全部システム入ってるはずだけど?」と思われるかもしれませんが,Snappyパッケージは,アプリに必要なものを仮想コンテナにすべて含んだ形で持つので,作成の際にいちいちパッケージをダウンロードし,ソースコードならコンパイルして,仮想コンテナ内にインストールします. しばらくすると,処理が終わり,

Snapped talker-listener_0.1_amd64.snap

と,snapファイルが生成されます. これをインストールするには,

$ sudo snap install --dangerous publisher-subscriber_0.1_amd64.snap

とします.インストールされたか確かめて見ましょう.

$ snap list Name Version Rev Developer Notes core 16-2.26.9 2381 canonical - talker-listener 0.1 x1 -

では,ノードを順番に起動してみましょう.

$ talker-listener.roscore $ talker-listener.talker $ talker-listener.listener

お馴染みの,talker-listenerのノードが動き始めたと思います.

ROS + Snappy Ubuntu Core (1) : いったい何なの?

iPhoneのAppStoreやAndroidのGooglePlayのようなアプリのマーケットインフラを,ロボットの世界にも導入するためにはどのような課題があるでしょうか?ROSはその開発当初から「Robot App Store」を視野に入れてきていますが,まだ実現していません.

その中で,最近のUbuntu Snappy Coreと呼ばれる仕組みの登場は,Robot App Storeの開設に大きく貢献するのではないかと思われます.

今後,数回に分けて,Ubuntu Snappy CoreとROSについて書いていきたいと思います.

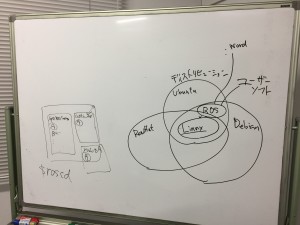

Ubuntuの事情

ROSがメインのベース・オペレーティング・システムとしているUbuntuは,年に2回のRegularリリースがあり,そのサポート期間は9ヶ月です.また,2年おきにLTS(Long Term Support)と呼ばれるリリースがあり,サポート期間は5年です.実用を求める人は安定なLTSを使いつつ,最新技術の取り入れや新規開発はRegularリリースを使う,というサイクルが続いています.

しかし,Ubuntuが対象とするデバイスは,デスクトップPCやサーバだけでなく,IoTやルータなどのエッジデバイスにも広がりつつあります.残念ながらUbuntu Phoneはついに陽の目を見ないことになるようですが…

これらのデバイスでは,セキュリティの観点から,Ubuntuのような同期的なものではなく,もっと不定期かつ細かい間隔の継続的なアップデートが欠かせません.また,耐障害性,たとえば不具合を含むソフトウェアが配信された際にロールバックする,などの機能が必要になります.

Snappy Ubuntu Core

これらの要求に対して,Ubuntuでは,IoTやエッジデバイス向けに,(Snappy) Ubuntu Coreと呼ばれる仕組みが開発されています.

これは,OSとデバイスドライバの分離,またカーネルとアプリケーションを分離して,それぞれを独立に,細かい周期でアップデートできるような仕組みにしよう,というものです.

ROSの事情

ロボットもまたIoTやエッジデバイスの一種と見ることができるため,今後ROSでも,このSnappyなパッケージシステムが主流になる可能性があります.また,ROSのリリースシステムも,ほころびが目立つようになってきています.

これまでROSはUbuntuと同様に,同期的なリリースを行ってきました.しかし,1年に1回のリリースでは,日進月歩の技術を取り入れるのに遅れが大きすぎる気もします.一方で,ROSを業務に使用する場合には,動作させることが優先され,頻繁にアップデートしない(できない)ようになってしまいがちです.

また,ROSのパッケージは,たくさんの外部ライブラリに依存しています.外部ライブラリのAPIが変更になるたびに,ROSのパッケージもそれに対応させる必要があります.仕様が変わる場合には,パッケージを対応させた上に動作確認も必要です.

そのため,リリースされるたびに,リリースから外れていくパッケージが多くなってきました.必要だしよく使われるパッケージであるにもかかわらず,リリースのために修正が必要だけど修正作業を行うメンテナがいない,という理由でリリースされなかったり,リリースが遅れたりするケースもあります.

もしROSを搭載したロボット製品を販売しようと考えた場合,UbuntuやROSが更新されたタイミングで,どのような仕様変更や不具合が混入するかわからず,それに対応するには膨大なリソースが必要であることが予想されます.

以上のようなことから,今後はSnappyなROSシステムが主流になるのではないかと,勝手ながら予想しています.

Canonicalにお勤めのロボットエンジニアの方(Kyle Fazzari氏)が精力的に情報発信をしているのも頼もしいです.4月に公開された以下の一連のブログと動画も必見です.

Roomblock(4): 低価格なレーザ距離計 RPLIDAR A2

前回はルンバと通信するための計算機として用いているラズベリーパイについて紹介しました.今回は,自律移動のためのキーパーツである,レーザ距離センサについて紹介します.レーザースキャナ,LIDAR(Laser Imaging Detection And Ranging)とも呼ばれます.

弱いレーザービームを発光し,物体への反射光を計測して,その時間差により物体までの距離を測ります.計測部分を回転させながら計測(スキャン)すれば,平面内の物体までの距離が計測できます.レーザービームを複数並べたり,細かく向きを変える機構を使うことで,平面内だけでなく3次元的な計測点が得られる3次元レーザ距離センサもあります.

一般的にレーザー距離センサは,2次元のものでも数十万円していたので,そう手軽に使えるものではありませんでした.しかしRoomblockで使っている SlamTech社のRPLIDAR A2 は,なんと5万円程度と破格なのです.

RPLIDAR用のROSドライバが公開されています.

$ sudo apt install ros-kinetic-rplidar-ros

として,

$ roslaunch rplidar_ros view_rplidar.launch

とするだけで,rvizで計測した点が表示されるお手軽さです.

計測可能距離は16m, 更新周期は10Hzと,高価なレーザスキャナと比べて性能では劣るものの,通常の屋内であれば地図生成や自己位置推定に問題はありません.スキャンは1度刻みで360度なので死角がありませんが,センサ上部がむき出しのままぐるぐると回転するので,動作中に触ってしまわないように注意が必要です.インターフェースはUSB2.0で,バスパワー駆動なのもうれしいところです.

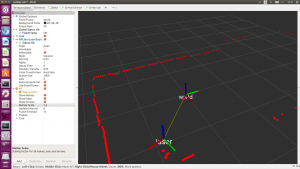

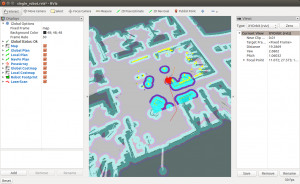

laser_scan_matcherパッケージで少し遊んでみましょう.

$ roslaunch rplidar_ros view_rplidar.launch

としてセンサを起動した後,

$ rosrun laser_scan_matcher laser_scan_matcher_node _base_frame:=laser

として,センサの水平を保ちながら,ゆっくりと動かしてみます.

初期状態ではworld座標系と一致していたlaser座標系が,センサの動きに応じて位置と姿勢がレーザのスキャンマッチングにより更新されていきます.センサを元の位置,姿勢に戻すと,だいたいworld座標系に一致しています.ただ,レーザのスキャンマッチングでは,フレーム間の移動量を推定してこれを積算するので,長く移動させるとエラーも積算されていきます.これを避けるためには,より高度な自己位置推定のアルゴリズムが必要になります.

次回はこれらの部品をルンバにのせるフレームを3Dプリンタで出力します.

Roomblockの詳細な作り方については,Instructablesで公開しています.ただし当社は,これらの内容によって生じるいかなる損害についても責任を負いません.興味がわいた方はあくまで自己責任で,チャレンジしてくださいね.

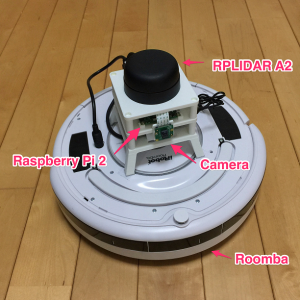

ルンバとラズベリーパイとレーザ距離センサによる自律移動ロボット Roomblock(3)

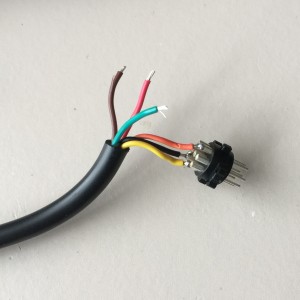

前回はルンバと通信するためのROIコネクタについて紹介しました.今回はルンバと通信するための計算機として用いている,ラズベリーパイ(Raspberry Pi)について書きます.

ラズベリーパイについては改めて言うまでもないかもしれませんが,低価格なARM搭載のボードコンピュータです.Roomblockで用いているのはラズベリーパイ2です.通常のPCと同じように,Ubuntuをインストールしたあと,ROSをインストールすることができます.

Raspberry Pi 2

ルンバのROIコネクタとラズベリーパイは,USB-シリアル変換器を使って接続します.変換器を内蔵したケーブル(秋月電子で購入できます)を使うと,ミニDINコネクタとはんだ付けするだけで写真のようなケーブルが出来上がります.Roomblockで唯一のはんだ付けが必要な部品ですが,3,4箇所をはんだ付けするだけなのでそれほど難しくないと思います.

USB-シリアル変換ケーブル

ラズベリーパイの電源はどうしましょうか?ルンバのROIポートにも電源が出ているのですが,これはルンバのバッテリの電圧がそのまま出ているので,使う場合には電圧の変換が必要になってしまいます.Roomblockでは市販のUSBモバイルバッテリーを別電源として使用することにしました.10000mAのものが3000円程度で購入できる,良い時代になりました…これでラズベリーパイを数時間は動作させることができます.

今回はここまでです.次はレーザースキャナについて紹介します.

Roomblockの詳細な作り方については,Instructablesで公開しています.ただし当社は,これらの内容によって生じるいかなる損害についても責任を負いません.興味がわいた方はあくまで自己責任で,チャレンジしてくださいね.

ルンバとラズベリーパイとレーザ距離センサによる自律移動ロボット Roomblock(2)

前回紹介したRoomblockに使えるルンバは,500, 600, 700, 800 シリーズと呼ばれるものです.これらの機種は,外部と通信するためのシリアルポートを備えています.ただし,現在の最上位機種のルンバ900シリーズは,画像による地図生成までできるすごいものですが,シリアルポートを備えていないのでRoomblockのベースとしては使用できないので注意してください.

ところでそのシリアルポートはルンバのどこにあるのでしょう?シリーズにより位置が異なります.500シリーズ,600シリーズは,上面のカバーを外さなければなりません.このカバーは4か所のツメで固定されていて,最初は少し硬いので外すのに力が必要です.ケガや破損に十分注意してください.

Roomba 500シリーズのROIコネクタ

700シリーズ,800シリーズは,ルンバ上面の取っ手の下にROIコネクタがあります.カバーを外す必要はなく,取っ手を持ち上げるだけでアクセスできます.

Roomba 700シリーズのROIコネクタ

Roomblockの詳細な作り方については,Instructablesで公開しています.ただし当社は,これらの内容によって生じるいかなる損害についても責任を負いません.興味がわいた方はあくまで自己責任で,チャレンジしてくださいね.

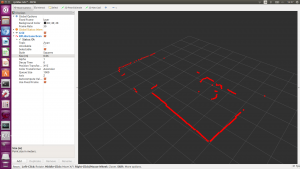

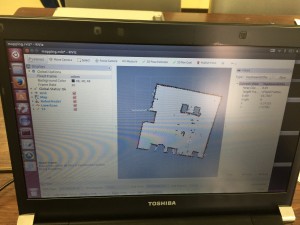

Roomblock: ループを含む大きな建物での地図生成

名城大学構内で実験させていただいたデータから,ROSの地図生成パッケージで地図を生成してみました.データはROSのbagファイルとして取得したので,同じデータに対して異なる地図生成パッケージを適用することが可能です.

ROSの地図生成のパッケージとして,

- gmapping

- slam_karto

- hector_slam

- Google cartographer

の4つのパッケージを用います.

これまで家屋や廊下など,比較的狭い環境で地図を作ってきました.それらの環境ではどの地図生成パッケージも,(誤差はともかくとして),自律移動に使えないような大きく矛盾する地図を作成することはありませんでした.狭い部屋では,基本的にレーザセンサのデータをずっとつなぎ合わせ続けることで,部屋の地図を作ることが可能です.

しかし,今回のデータは非常に大きな建物の長方形の廊下を一周したものです.廊下を一周回って元の場所に戻ってきた時,それが元の場所であることを認識せず,そのままレーザセンサのデータをつなぎ合わせていくと,最初に作った地図と矛盾したものを上書きし続けてしまいます.これを避けるためには,現在居る場所が以前来たことのある場所であると認識した上で,地図全体を辻褄があうように生成しなければなりません.これは”loop closure”と呼ばれ,地図生成では非常に難しい問題です.

以下の動画は,4つのパッケージで地図を生成した結果をまとめたものです.地図のグリッドサイズは5cmとし,各パッケージのパラメータのほとんどはパッケージの規定値のままで,一部のパラメータのみ少し調整しました.

gmappingは非常に健闘しました.途中の廊下は真っ直ぐになっておらず,地図の形は後半にかけて不正確になっています.これはルンバのあまり正確でないオドメトリを少し信頼しすぎているようです.しかし,一周回ってきた最後に注目してください.以前来たことのある場所だと認識し,辻褄があうように地図全体を変形させました.矛盾のない,ほぼ正しい地図が出来上がりました.

slam_kartoは,今回はloop closureの検出に失敗してしまいました.一周回ってきた後,最初に作った地図を破壊しながら,新しい地図を上書きしていきます.矛盾した地図となってしまいました.

hector_mappingには,じつはloop closureの機能がありません.また,車輪の回転速度(オドメトリ)を使っていません.そのため,この環境ではうまく地図を作ることはできませんでした.

Google cartographerは最後発で,しかもこのような大規模環境の地図を作るために開発されたアルゴリズムです.やはりループを正しく閉じることに成功しました.

最終的に生成された地図(左から,gmapping, slam_karto, hector_slam, cartographer)

以上の結果は,どのパッケージやアルゴリズムが優れているか,どのパッケージを選ぶべきかということを示すものではないことに注意してください.今回,パラメータはほとんどチューニングしなかったので,それぞれのパッケージの最高の性能が出ているわけではありません.また,それぞれのアルゴリズムには得意不得意があるので,課題に対してどれが良いかは,実際に試してみないと分からないことが多いはずです.

現在のところROSはこのような様々な地図生成パッケージを比較検討できる唯一のプラットフォームです.オープンソースの利点を活かし,ぜひご自分の手で確かめてみることをお勧めします.

TORKでは,自律移動編を含むROS初級,中級のワークショップ,企業や大学でのプライベートワークショップのご依頼も承っております.お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ルンバとラズベリーパイとレーザ距離センサによる自律移動ロボット Roomblock(1)

弊社のROS中級ワークショップ・自律移動編では,ルンバをベースとした自律移動ロボット”Roomblock”を教材として使用しています.不定期なエントリとして,このRoomblockの内容を紹介していきます.

まず,Roomblockは車輪移動台車として,iRobot社のお掃除ロボット,ルンバ(Roomba)を使用しています.驚かれる方もいるかもしれませんが,ルンバは実は通信用のシリアルポートを持っていて,パソコン等から操作したりセンサ情報を取得することが可能なのです.ルンバのこの機能は,発売当初から一部のエンジニアやホビイストの間で話題になり,ルンバを操作して楽しむ”Roomba Hacking”がブームとなったほどです.ROSが登場するよりもずっと前の話です.

もう壊れてしまいましたが,2007年に私が初めて購入したRoombaです

iRobot社からは,”iRobot Create”という,掃除機能を省いた教育向けのルンバが発売されていたこともありました.ROSでも初期のTurtlebotプラットフォームは,このCreateをベースにしていました.現在はiRobot Createの販売は終了しており,TurtlebotもKobukiを用いたTurtlebot2, そしてRobotis社による独自プラットフォームTurtlebot3へと進化しています.

そんな中,なぜ今お掃除ロボット,ルンバを教材のベースとしたのでしょうか?3つ理由があります.

1つめは,ロボットの全体の価格をできるだけ抑えるためです.発売当初は割高に感じたルンバも,普及が進み今では3万円台から手に入るようになっています.屋内での自律移動に適したサイズ,車輪,センサなどを備えたロボットとしては破格です.

2つめは,ROSのパッケージがすでに存在していることです.それらを利用して,自律移動技術の本来的な目的である,地図生成や経路計画のソフトウェアの学習をすぐに始めることができます.

3つめは,ルンバが掃除をしてくれるからです…当たり前ですね.しかし,余暇にロボティクスを勉強したいエンジニアが,家族に「自律移動ができる10万円のロボットを買いたい」と言って納得してもらえるでしょうか?「ルンバなら掃除もしてくれるよ!」というとみんな喜んでくれます.

最近では「ルンバ対応」のリビングチェアなるものまであります

おっと,つい話が長くなってしまいました.私ルンバが大好きなもので….今回はここまでです.

Roomblockの詳細な作り方については,Instructablesで公開しています.ただし当社は,これらの内容によって生じるいかなる損害についても責任を負いません.興味がわいた方はあくまで自己責任で,チャレンジしてくださいね.

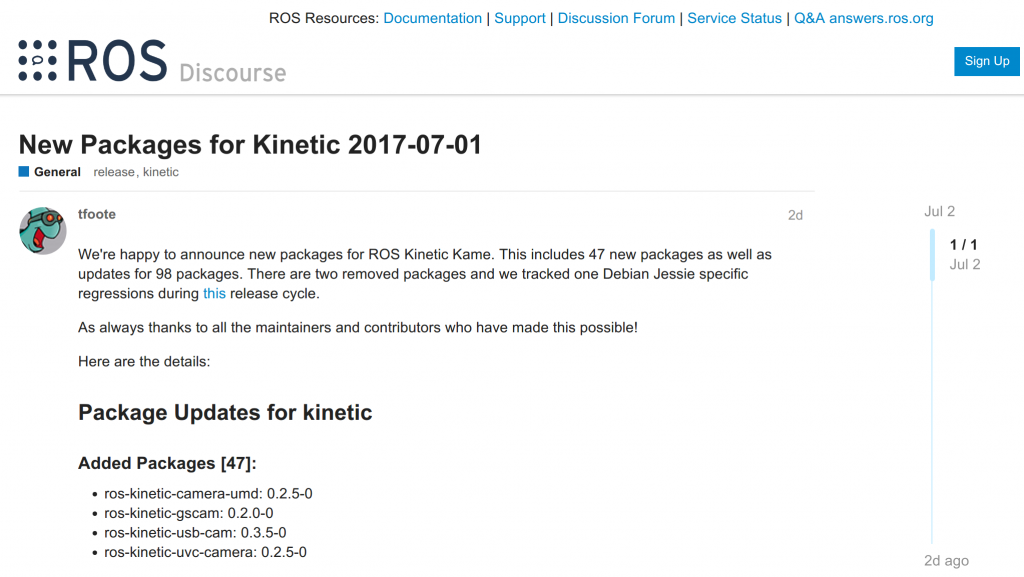

Kinetic 用 ROS USB カメラドライバのリリース

長らく懸案だったKinetic用のROS USBカメラドライバが一斉リリースされました.

これらのパッケージ,Indigoまでは数多く利用されていましたが,最近はメンテナが不在になっており,ながらくKineticでは利用できませんでした.

このたび,Orphaned Package Maintainersという有志グループが立ち上がり,Kinetic移行でもリリースされる体制が確立されました.

これに従来からリリースされていた以下の加えて6つのドライバから自由に選ぶことが出来るようになりました.ROSを使った画像処理プログラミングをお楽しみ下さい.

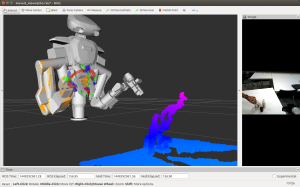

名城大学にて自律移動ロボットのデモ&実験をさせていただきました

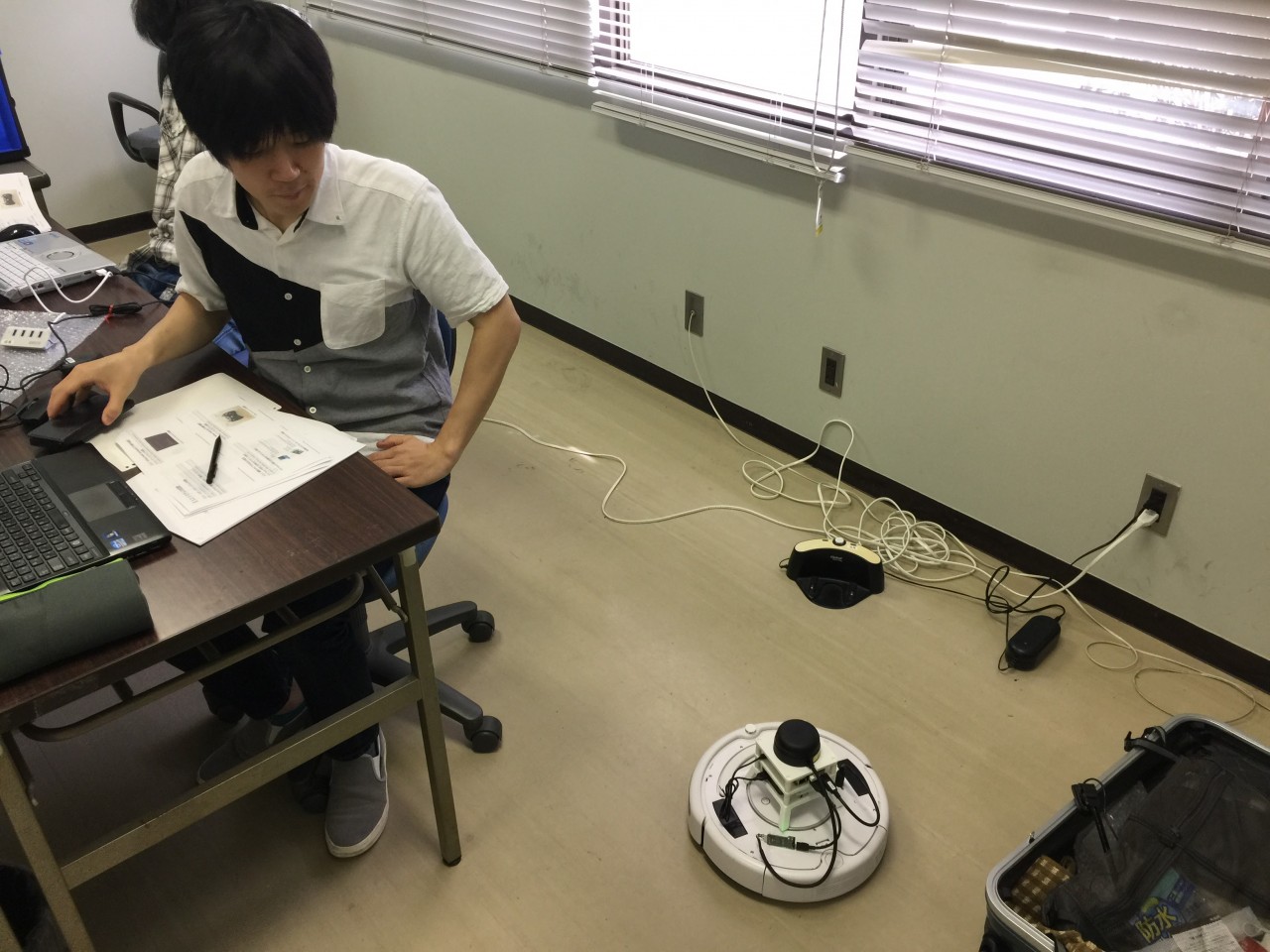

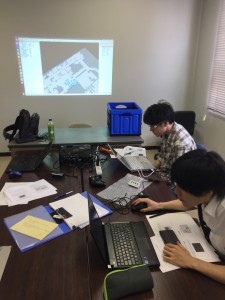

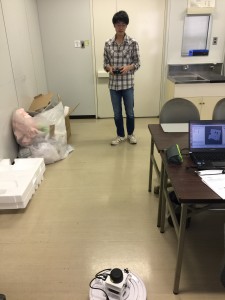

ROS初級と中級・自律移動編を受講頂いた名城大学メカトロニクス工学科様のご好意で,自律移動ロボット”Roomblock”のデモンストレーションをさせていただきました.

ものの数分で部屋の地図を作った後,障害物を避けながら自律的に移動するロボットに,学生さんたちも興味津々でした.

TORKでは,自律移動編を含むROS初級,中級のワークショップ,企業や大学でのプライベートワークショップのご依頼も承っております.お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

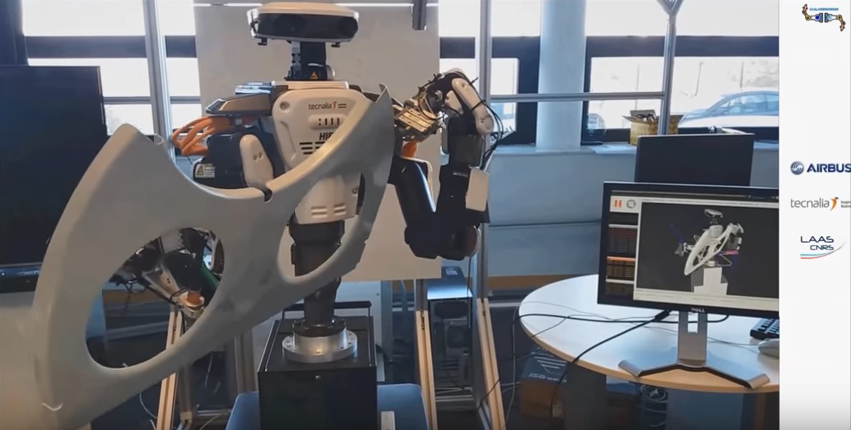

NEXTAGE OPEN も登場:MoveIt! 5周年記念モンタージュビデオ

ROS の動作計画ライブラリ MoveIt! が,5周年を記念してアプリケーション例のビデオを公開しました.

MoveIt! チームがこのようなビデオを公開するのは4年前・2013年に次いで2度目ですが,ソフトウェア公開間もなかった当時と比べ,だいぶ Pick&Place,物を掴んで目的地に設置するというタスクが多く,技術の進展が窺えます.個人的には MoveIt! の課題領域としても挙げられている台車,水中ローバ等の移動体に取り付けられたアームの制御例が数件含まれ,既に実現されてるのかも気になります (このページの “Mobile base integration”).

また弊社がその opensource 版ソフトウェアのメンテナンスに積極的に関わり,サポートサービスも提供させて頂いているカワダロボティクス社製 NEXTAGE OPEN も登場します.弊社ブログ上でもお馴染み?の Spain のシステムインテグレータ・Tecnalia 社が手がける Airbus 向けアプリと思われます.

TORK では2013年の創業以来,ROS,MoveIt! のソフトウェア改良,普及に貢献し続けています.貴社ロボットへの MoveIt! の導入御検討であれば,弊社ワークショップで体験もできますので,参加を是非御検討下さい.

P.S. 今回のビデオの開発者一覧も公開されました.

(0:06) Delft Robotics and TU Delft Robotics Institute

(0:09) Techman Robot Inc.

(0:13) Correll Lab, CU Boulder

(0:37) Nuclear & Applied Robotics Group, Unv Texas

(0:50) Beta Robots

(0:55) GIRONA UNDERWATER VISION AND ROBOTICS

(1:03) Team VIGIR

(1:34) Honeybee Robotics

(1:49) ROBOTIS

(1:58) TECNALIA

(2:05) Correll Lab, CU Boulder

(2:26) TODO Driving under green blocks

(2:38) ROBOTIS

(2:54) Fetch Robotics

(3:05) Hochschule Ravensburg-Weingarten

(3:12) TU Darmstadt and Taurob GmbH – Team ARGONAUTS

(3:20) isys vision

(3:27) Technical Aspects of Multimodal System Group / Hamburg University

(3:33) Clearpath Robotics

(3:43) Shadow Robot

ROS Workshop Schedule from July to August 20172017年7月-8月のROSワークショップ日程

Here are the schedule of our ROS workshop series in Summer 2017!

July 05 Wed. 13:30- Introductory

July 12 Wed. 13:30- Introductory

July 19 Wed. 13:30- Introductory

Aug. 02 Wed. 13:30- Introductory

Aug. 08 Tue. 13:30- Introductory

Aug. 30 Wed. 13:30- Introductory

Venue: Yurakucho, Tokyo

Inquiries: info[at]opensource-robotics.tokyo.jp

以下日程でROSワークショップを行います.

7月05日(水)13:30~ ROSワークショップ初級編

7月12日(水)13:30~ ROSワークショップ初級編

7月19日(水)13:30~ ROSワークショップ初級編

8月02日(水)13:30~ ROSワークショップ初級編

8月08日(火)13:30~ ROSワークショップ初級編

8月30日(水)13:30~ ROSワークショップ初級編

場所は都内・有楽町の会議室での実施を予定しています.

中級編についてはご要望があり次第,日程を調整いたしますのでメイルにてお問い合わせください.

(初級編を受講した方を対象としております.中級マニピュレーション編のページをご参照ください)

お申込みは以下より詳細をご確認の上,ページ内のお申込みリンクよりエントリをお願い致します.

上記以外での日程の調整,その他ご相談,開発委託,出張ワークショップ,カスタマイズワークショップも承っております.お気軽にご相談ください.

info[at]opensource-robotics.tokyo.jp

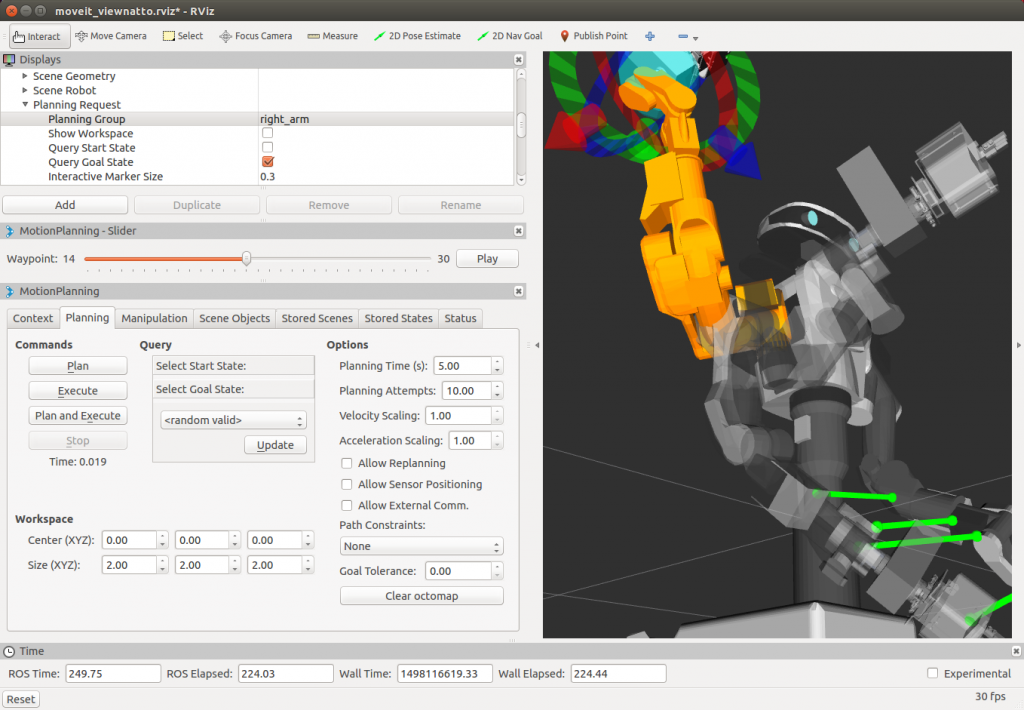

MoveIt! 計画された軌道のビジュアライゼーション

2017年6月初のパッケージ更新により MoveIt! が更新され,これまで要望のあった軌道の目視確認機能が追加されました.

これまでは,生成させた経路を確認するには,RViz 上で “Loop Animation” をオンにして経路を反復再生させる手があったかと思います.この方法だと経路の途中の任意の経由点で止めることはできませんでした.

今回追加された機能を使うと,RViz 上でスライダを移動することにより,軌道の経由点を静止した状態で目視確認できます.

As you see on the slider on the left side, you can now introspect each waypoint in a planned trajectory on MoveIt! on NEXTAGE Open.

本機能を有効にする方法はチュートリアルを参照下さい.

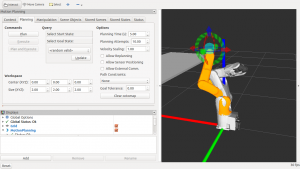

ROS Intermidiate (Navigation) Workshop in Nagoya 名古屋にてROSワークショップ中級・自律移動編を開催しました

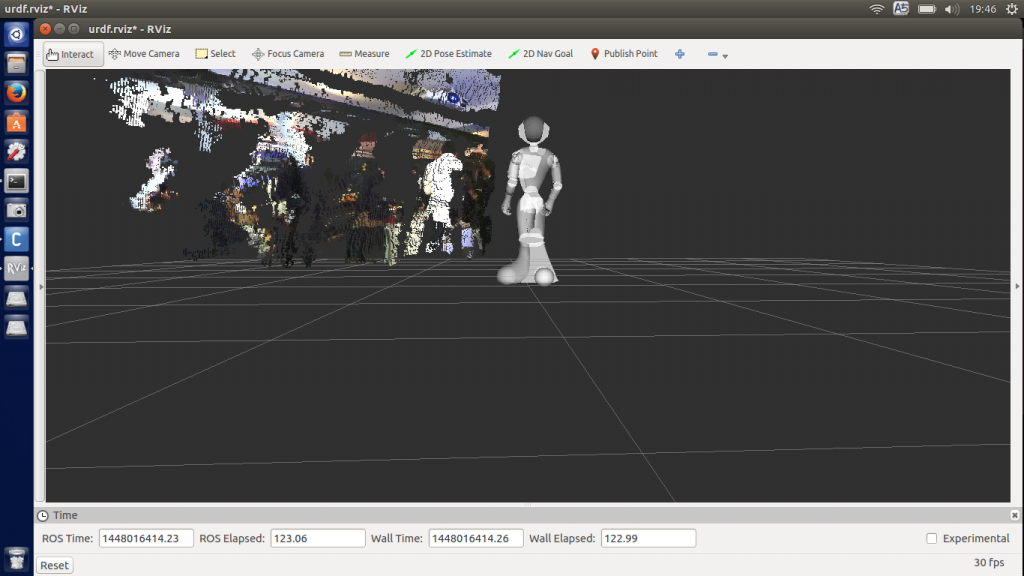

We had the intermidiate ROS workshop on navigation at Meijo University, Nagoya, Aichi. They learned the navigation features of ROS using simulation and a real robot named “Roomblock”, Roomba based robot. Mapping, localization, control are

Thanks everyone, and well done!!

前回の初級編に続き,名古屋市の名城大学メカトロニクス工学科で,プライベートROSワークショップ中級・自律移動編を開催しました.この自律移動編は今年度から新しく始まったもので,初めての開催となります.

中級・自律移動編では,まずシミュレータを用いた自律移動技術のハンズオンを行います.つぎに,iRobot社の掃除ロボット,ルンバをベースにした自律移動ロボット”Roomblock”を用いて実際に地図生成と自律移動を行います.”Roomblock”はラズベリーパイとLIDAR(レーザ距離スキャナ)を備えた立派な自律移動ロボットで,部屋の地図を作り,目的地を設定してそこに移動することができます.最後に,ROSの自律移動機能の解説(全体の構成,関連するtopic, move_baseの仕組みなど)を受け,ハンズオンで出てくる疑問点を解消していきます.

車輪移動ロボットの操作方法,地図の生成,自律移動を実際にやってみることで,自律移動技術の理解がより深まるものと思います.参加者の皆様方,お疲れ様でした.今後の研究開発の一助となれば幸いです.

このように,TORKでは企業や大学でのプライベートワークショップのご依頼も承っております.また,本年からは中部地区での開催を増やしていこうと考えています.お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Basic Workshop in Nagoya. 名古屋にてROSワークショップ初級編を開催しました

We had ROS Workshop at Meijo University, Nagoya, Aichi. They run through the basic of ROS, such as sensing, actuating and connecting them together. Many questions and answers was made, for comprehensive understanding to use ROS.

Great work, everyone!!

名古屋市の名城大学メカトロニクス工学科で,プライベートROSワークショップ初級編を開催しました.

初級編では環境の構築からセンシングデバイス(LeapMotion),ラジコンサーボ(Dynamixel)をROSで動かすところまでを半日で行いました.その中で出てくる疑問点(たとえばROSの概念的な部分から具体的な操作など)にもお答えいたしました.

これからバリバリ研究して行こうという学生のみなさんに,まずはROSを効率よく使っていくお手伝いができたのではないかと思います.

ROSを初めて勉強する人へのブログも公開しています. 合わせてご参考になさってください.

このように,TORKでは企業や大学でのプライベートワークショップのご依頼も承っております.また,本年からは中部地区での開催を増やしていこうと考えています.お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop for Beginners on 14th June ROSワークショップ初級編を開催しました

We had ROS Workshop at Yurakucho, Tokyo.

We used custom ROS-preinstalled LiveUSB, so people had ROS experience without change your PC environment.

All of attendee ran through the all topics.

Great work, everyone!!

今回も有楽町の会議室にてROSワークショップ初級編を開催しました.

参加者の方が開発中のシステムの質問もお受けしました.皆様お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップ,その他OSSに関するご相談も承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

TurtleBot3!

本日は株式会社ROBOTIS日本支店長の柴田さん,森永さんにお越しいただき有楽町にてミーティングを実施しました.

噂のTurtleBot3のプロトタイプをお持ちいただきました!

夏の正式発売を前に最後の追い込み作業中だそうです.発売が楽しみですね!

夏まで待てない人はドキュメンテーションを読んでわくわくしましょう.

http://www.turtlebot.com/

http://turtlebot3.robotis.com/en/latest/

https://github.com/ROBOTIS-GIT/turtlebot3

ROS,OSS,ロボティクスに関するご相談,プライベートワークショップ等,お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop for Beginners on 25th May ROSワークショップ初級編を開催しました

We had ROS Workshop at Yurakucho, Tokyo.

We used custom ROS-preinstalled LiveUSB, so people had ROS experience without change your PC environment.

All of attendee ran through the all topics.

Great work, everyone!!

今回も有楽町の会議室にてROSワークショップ初級編を開催しました.

積極的な質問をいただきながら最後まで完遂しました.皆様お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop Intermediate Course (Navigation) is coming soonROSワークショップ中級・自律移動編を始めます!

当協会では,

- ROSワークショップ初級編

- ROSワークショップ中級・マニピュレーション編

- ROS ワークショップ初級編・産業用双腕 Baxter

といった,ROSを学習するためのワークショップを開催してまいりました.

2017年度からは新たに,

- ROSワークショップ中級・自律移動編

の開催を計画しております.

「自律移動編」では,シミュレーションででROSの自律移動を体験していただくハンズオン,ラズベリーパイ(Raspberry Pi)とルンバ(Roomba),RPLIDARを用いた自律移動ロボット“Roomblock”での実際の地図作成,自己位置推定といった自律移動に必要な機能を実践的に学んでいただけます.また,ROSの自律移動機能の全体像や,構成パッケージについても解説いたします.

こちらのセミナーは有償となります.金額については,info[a t]opensource-robotics.tokyo.jp までお問い合わせ下さい.正式な開催日時等決まりましたら,また当ウェブサイトにてお知らせさせて頂きます.出張ワークショップも承っております.お気軽にご相談ください.

引き続き,「初級編」「マニピュレーション編」「Baxter編」の参加者も募集しております.詳細は,上記メールアドレスまでお問い合わせ下さい.

We have been coordinated three workshops for ROS learners:

- ROS workshop basic course

- ROS workshop intermediate course (Manipulation)

- ROS workshop with Baxter

Now, we are pleased to announce a new course will be added soon:

- ROS workshop intermediate course (Navigation)

This course is focus on the navigation system of ROS. You can learn the advantage of ROS navigation using simulation. Furthermore, we prepare mobile robot named “Roomblock”, which consists of Roomba, Raspberry Pi and RPLIDAR. The overview of the navigation system and the packages are also lectured.

Same as before we’re coordinating in Japanese language but any interest is appreciated toward info[a t]opensource-robotics.tokyo.jp.

ROS Workshop for Beginners on 10th May ROSワークショップ初級編を開催しました

We had ROS Workshop at Yurakucho, Tokyo.

We used custom ROS-preinstalled LiveUSB, so people had ROS experience without change your PC environment.

All of attendee ran through the all topics.

Great work, everyone!!

今回は有楽町の会議室にてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

一つ一つのタスクに対して積極的な質問をいただきながら最後まで完遂しました.お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

(図面付き) NEXTAGE OPEN の頭部カメラのキャリブレーションHead-mount stereo camera calibration for NEXTAGE OPEN

NEXTAGE OPEN で頭部ステレオカメラを利用する際の,カメラの姿勢を手軽にキャリブレーションする方法を公開しました.

ROS では幾つかカメラを用いたキャリブレーション用パッケージが利用できます.ROS 初期の代表的ロボット PR2 向けに作られた calibration,産業用ロボット向けに豊富な機能を持つ industrial_extrinsic_cal,最近ではキャリブレーション結果を用いてロボットのキネマティクス情報を更新してくれる robot_calibration というのもあります.いづれもハードウェア and/or ソフトウェアの前準備が大変だったり,高機能ゆえに計算に時間がかかったりと,扱いに慣れが必要です.

今回ご紹介する方法は基本的にチェッカーボードをロボットに固定さえすれば実施可能です.詳しい方法を ROS wiki に記載しています.ステレオカメラで胸部あるいは腰部に固定したチェッカーボードを認識することにより,頭部カメラのロボット上の相対姿勢を取得します.カメラの据付位置座標が分かれば,Gazebo シミュレータ上でもキャリブレーションを行い相対姿勢を取得することが可能です.

胸部に付けたチェッカーボードを認識中

ロボットに固定したチェッカーボードを認識することで,ROS の座標変換ライブラリ “tf” により,カメラの正確な相対姿勢が判明します.

Gazebo 上の Kinect でチェッカーボードを認識している様子.

なお,キャリブレーションに用いたチェッカーボードの NEXTAGE OPEN 本体への取付けに必要な部品一式の図面もGitHub 上で公開しています.また,TORK では Xtion をかっこ良く頭部に取り付けたい場合 外装を御用意しています (日本国内のみ).

現状では上記 wiki ページで紹介されている方法は Kinect 或いは Xtion を利用しています.NEXTAGE OPEN がデフォルトで搭載する頭部の Ueye カメラ二基を用いても同じ方法は有効のはずですが,Ueye 個別の操作方法は未だ記載していません.ROS wiki は誰でも編集できるので,もし Ueye でキャリブレーションに成功した方がいたら是非情報を追記頂けると,全世界の NEXTAGE OPEN ユーザが喜ぶと思います!

Recently we’ve updated the instruction for the NEXTAGE OPEN’s calibration using head-mount stereo cameras.

There has been mutilple camera/robot calibration packages in ROS; calibration package worked well for the PR2 robot, a high-functional reference model of ROS in the early era until very recently. Then for industrial usage industrial_extrinsic_cal was developed with abundant functionalities to cope with complexed needs. Relatively newer robot_calibration package, which is maintained by the warehouse robot manufacturer Fetch, even updates the robot’s kinematics parameters using the calibration result. Almost all of these practical features come with a cost of labor in hardware and/or software, however.

The approach we’re presenting is simple enough since all you need is a checkerboard — not even a board but a plain or even a piece of paper will do as long as checker matrix is printed on it. Detailed steps are available on ROS wiki. Basically get the pose of the camera mounted on top of the head or actually anywhere on the robot, by recognizing the checkerboard. You can also carry out the calibration on Gazebo simulation as long as you know the location to attach the camera so that you can spawn the camera’s 3D model in the virtual world.

Detecting a checkboard at the chest.

Recognizing the checker pattern, which is in a fixed pose w.r.t the robot, yields the camera’s relative pose w.r.t the robot as a result of “tf” computation.

Seeing checkerboard through a simulated Kinect on Gazebo.

We’ve also made the design of the checkerboard kit publicly available on NEXTAGE OPEN’s GitHub repository so that any handyperson can go through these steps.

As of now the instruction in the wiki above only uses Kinect or Xtion, i.e. the operation of the Ueye cameras that NEXTAGE OPEN comes with by default is a bit different but that’s not documented yet, although the calibration part is intended for any ROS-based stereo camera so it should work for Ueye too. Every one is welcomed to edit ROS wiki to add your findings in this regard. Power of opensource!

ROS Workshop Schedule from April to June 20172017年4月-6月のROSワークショップ日程

Here are the schedule of our ROS workshop series during the 2nd three months of 2017!

Apr. 28 Fri. 13:30- Introductory

May 10 Wed. 13:30- Introductory

May 18 Thu. 13:30- Introductory

May 25 Thu. 13:30- Introductory

June 08 Thu. 13:30- Introductory

June 14 Wed. 13:30- Introductory

Venue: Yurakucho, Tokyo

Inquiries: info[at]opensource-robotics.tokyo.jp

以下日程でROSワークショップを行います.

4月28日(金)13:30~ ROSワークショップ初級編

5月10日(水)13:30~ ROSワークショップ初級編

5月18日(木)13:30~ ROSワークショップ初級編

5月25日(木)13:30~ ROSワークショップ初級編

6月08日(木)13:30~ ROSワークショップ初級編

6月14日(水)13:30~ ROSワークショップ初級編

場所は都内・有楽町の会議室での実施を予定しています.

中級編についてはご要望があり次第,日程を調整いたしますのでメイルにてお問い合わせください.

(初級編を受講した方を対象としております.中級マニピュレーション編のページをご参照ください)

お申込みは以下より詳細をご確認の上,ページ内のお申込みリンクよりエントリをお願い致します.

上記以外での日程の調整,その他ご相談,開発委託,出張ワークショップ,カスタマイズワークショップも承っております.お気軽にご相談ください.

info[at]opensource-robotics.tokyo.jp

We have moved !移転

We are pleased to announce that our office will be relocated to the following address as of April 1, 2017.

Location:

the 6th floor of the Tokyo Kotsu Kaikan building

2-10-1 Yurakucho

Chiyoda-ku, Tokyo, 100-0006, Japan

Phone number is unchanged.

2017年4月1日に移転いたしました.

移転先住所

〒100-0006

東京都千代田区有楽町2-10-1東京交通会館ビル6F

電話番号に変更はありません.

有楽町・銀座で皆様とお会いできることを楽しみにしております.

引き続きご支援賜りますようお願い申し上げます.

ROS Workshop for Beginners on 22th March ROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

We used custom ROS-preinstalled LiveUSB, so people had ROS experience without change your PC environment.

All of attendee ran through the all topics.

Great work, everyone!!

本日も本郷のミーティングスペースにてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

一つ一つのタスクに対して積極的な質問をいただきながら最後まで完遂しました.お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop for Beginners on 16th March ROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

One participant prepared own Ubuntu PC and installed indigo, the other used our LiveUSB.

You can experience ROS workshop by the LiveUSB without installation of Ubuntu on your machine.

Thanks you for joining us!!

今回も本郷のオープンスペースにてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

実施時間中にROSに関するお困りごとだけでなく,オープンソースを社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

出張セミナー,カスタマイズワークショップ,個別コンサルティング,プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop for Beginners on 2nd March ROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

One participant prepared own Ubuntu PC and installed indigo, the other used our LiveUSB.

You can experience ROS workshop by the LiveUSB without installation of Ubuntu on your machine.

Thanks you for joining us!!

今回も本郷のオープンスペースにてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

実施時間中にROSに関するお困りごとだけでなく,オープンソースを社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

出張セミナー,カスタマイズワークショップ,個別コンサルティング,プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop for Beginners on 22th Feburary ROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

We used custom ROS-preinstalled LiveUSB, so people had ROS experience without change your PC environment.

All of attendee ran through the all topics.

Great work, everyone!!

本郷のミーティングスペースにてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

一つ一つのタスクに対して積極的な質問をいただきながら最後まで完遂しました.お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop Schedule, from February to March 20172017年2月-3月のROSワークショップ日程

Here are the schedule of our ROS workshop series during the first three months of 2017!

Feb. 22 Wed 13:30- Introductory

Mar. 02 Thu 13:30- Introductory

Mar. 16 Thu 13:30- Introductory

Mar. 22 Wed 13:30- Introductory

Mar. 29 Wed 13:30- Introductory

Venue: Hongo, Tokyo

Inquiries: info[at]opensource-robotics.tokyo.jp

以下日程でROSワークショップを行います.

2月22日(水)13:30~ ROSワークショップ初級編

3月02日(木)13:30~ ROSワークショップ初級編

3月16日(木)13:30~ ROSワークショップ初級編

3月22日(水)13:30~ ROSワークショップ初級編

3月29日(水)13:30~ ROSワークショップ初級編

場所は都内・本郷のミーティングスペースでの実施を予定しています.

中級編についてはご要望があり次第,日程を調整いたしますのでメイルにてお問い合わせください.

(初級編を受講した方を対象としております.中級マニピュレーション編のページをご参照ください)

お申込みは以下より詳細をご確認の上,ページ内のお申込みリンクよりエントリをお願い致します.

日程の調整,その他ご相談,開発委託,出張ワークショップ,カスタマイズワークショップも承っております.お気軽にご相談ください.

info[at]opensource-robotics.tokyo.jp

ROS Workshop for Intermediate Manipulation on 31th January プライベートROSワークショップ中級・マニピュレーション編を開催しました

We had ROS Workshop for Intermediate Manipulation at Nagoya, Japan.

The participants also joined our Beginners Workshop a few weeks ago, then re-setup own PC and review all contents.

Thanks you for joining us!!

今回は企業様の会議室をお借りして,プライベートROSワークショップ中級・マニピュレーション編を開催しました.

長時間の講習お疲れ様でした.ご依頼いただきありがとうございました.

プライベートワークショップ,出張ワークショップ,カスタマイズワークショップ,その他ご相談も承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

2017 MoveIt! 新機能その2;動作の停止.求ム実機テスター!2017 MoveIt! update pt.2; Stopping motion on NEXTAGE needs your help

MoveIt! の年初一発目の更新については前回機能を一つ,NEXTAGE Open を利用してお伝えしました.今日ご紹介する動作計画の停止機能は,弊社でも要望を何度もユーザ様から伺っていた機能です.

平たく言えば,ロボットが任意の動作を実行している最中に,途中で停止する機能です.動作を停止したい状況は安全に関わるケース以外でもいろいろ考えられるため,非常停止装置などを用いて危険回避目的でロボットの全動作を停めるのではなく,プログラミングのレベルで特定の動作だけを停止ができるとアプリケーション開発上嬉しいことがあります.MoveIt! ではこの停止する標準的な方法がなかったのですが,今回追加されました (ちなみに本機能の作成は GSoC で日本人の修士学生が主導した模様).

早速 Pepper のシミュレーションで使ってみました.

In the previous post we introduced one of the many new features that were added to MoveIt! with its first update in 2017. Next feature we want to mention is the “stop motion”, which we’ve received many questions from our NEXTAGE users about.

Other than situations where you need to stop robots to move for the safety reasons, there can be many cases you want to stop/cancel/halt your robot for your application. The standard way to achieve this in MoveIt! had been lacking, which is finally organized this time (lead by a student at GSoC project by the way).

It works well with Pepper robot on simulation. You see the arm stops as soon as the “stop” button on RViz was clicked.

RViz 画面上に新たに追加された “Stop” ボタンを押すと,腕の動作が止まっているのがわかりますでしょうか.

この便利機能なのですが,弊社がサポートする NEXTAGE Open のオープンソースソフトウェアではまだ動作しません.修正パッチが作成され,シミュレーション上では期待通り動作することが確認されましたが,ロボット実機の挙動への影響があり得るため,実機テストが必要となっています.NEXTAGE Open をお持ちの方々で,もしテストに協力しても良いという方がいらっしゃれば,info[a_t]opensource-robotics.tokyo.jp 宛に連絡頂くか,Github 上の当該の問題のチケットに書き込みいただければ,ご支援させて頂きます.

This nice feature, however, does not YET work with the NEXTAGE Open. Don’t worry much, there’s a work going on already and we confirmed a patch submitted from a community member solves the issue on simulation! We just need to test the patch on the real NEXTAGE Open robot, and this is where we need a help from the robot owners. If you think you can help us testing with your own robot, please contact TORK at info[a_t]opensource-robotics.tokyo.jp or joint the discussion at the ticket for this issue on Github so that we’ll communicate with you. Thank you for your understanding toward opensource!

First MoveIt! Update in 2017. Using it on NEXTAGE pt.12017年始早々 MoveIt! 新バージョンがリリース.NEXTAGE で使ってみる その1

MoveIt! の最新バージョンが公開になりました.昨2016年にメンテナンスチームがリニューアルして以降,MoveIt! の開発が活発になり,それまで溜まっていた問題報告やパッチ候補の処理が加速しました.今日現在利用可能な ROS の3つの異なるディストリビューションそれぞれに最新版がリリースされています (Indigo 0.7.6, Jade 0.8.3, Kinetic 0.9.3).今回のリリースではバグ修正に加え,ユーザの要望の高かった機能も幾つも追加されています.その内の一つの機能をカワダロボティクス社の NEXTAGE Open のシミュレータを用いて見てみます.

1.軌道実行時の際の速度・加速度をの動的に変更

MoveIt! の RViz プラグイン上に新たな機能が追加されました.スピンボックス上の値を 0-1 の間で変更することでロボットアームの軌道実行の速度,加速度を変更できます.

御自身のロボットの3次元モデルファイル (URDF 或いは SRDF) 内に指定している関節速度/加速度を0-1の間でスケールすることができるようになっています.

New version of MoveIt! binary 0.7.6 is just released for ROS Indigo, first time in 2017 (for sure!) and first release since June 2016. This version comes with some long-wanted features (along with bug fixes of course) that we’re trying out using NEXTAGE simulator.

1. Changing trajectory velocity and acceleration during runtime

Changing the speed of the trajectory during runtime has been one of FAQs from NEXTAGE users who use MoveIt!, let alone many MoveIt! users on the globe. Now through MoveIt! RViz plugin you can conveniently configure that on the fly on the spinboxes added.

RViz 上でなくプログラマティックに変更したい場合は MotionPlanRequest トピックの値を変更することで runtime/プログラム実行中に変更できます.

次回に続く.

To configure that programmatically, see this tutorial that explains chainging MotionPlanRequest topic would do the work.

TORK is very actively contributing the development and maintenance of MoveIt!.

【2016年プレゼント企画】Opensourceに貢献しましょう!

皆様,2016年お世話になりました.また,特にロボティクス関連のオープソースへご協力頂いた皆様,ありがとうございました.

皆様のご貢献への感謝として,ささやかではありますが以下の写真にあるROS初級編資料やROS対応LiveUSBをプレゼントする企画を実施します.

2016年中に皆様自身が行った,

- ROS JAPAN Users GroupのMLへの投稿やanswers.ros.orgへの質問/回答

- roswikiへの情報追加・修正

- githubでのソフトウェア公開

など,オープンソースへの貢献についてリンクを頂いた皆様に,何らかのプレゼントを送付させていただく予定です.是非ご応募下さい.また,質問等されていない方は,ぜひ今からでも間に合いますので,ML等へのご質問をしていただければと思います.

まだオープンソースに貢献できていないけれどどうしても今プレゼントがほしい方も,アンケートにお答えいただければ数がある限り対応いたします.是非アンケートに回答して応募してみてください!

プレゼントは要らないけれどアンケートに答えたい方も大歓迎です!

締め切りは2017年1月10日(火)です.

ご応募お待ちしております!

応募アンケートリンク

※応募多数の場合は抽選になります.ご容赦くださいませ.

弊社の情報発信はこのblogとFacebook,twitterアカウントがあります.

FBにいいね!やtwitter投稿のリツイートもお待ちしております!

Dynpick force-torque sensor ROS driver update thanks to opensource contributionOpensource にしているおかげで Dynpick 力覚センサ の ROS ドライバの対応機種が増えました

弊社がメンテナンスに貢献している,ワコーテック社の力覚センサ Dynpick の ROS ドライバは,これまで販売終了機種でしか動作確認ができていませんでしたが,販売中の機種でも動作確認ができました.

...といっても弊社が動作確認を行ったのではなく,オープンソースコミュニティのユーザ (独・Fraunhofer IPA の方) がセンサを購入,動作させて報告を下さいました.

対応がとれた機種に関しては,同ドライバの wiki ページに掲載していきます.動作確認の報告は,Github ページで行って頂けると幸いです.

ROS device driver for force-torque sensor Dynpick, one that TORK joins its maintenance, has been known to work for a discontinued product only so far. Now someone in the opensource community just confirmed that the package works with a product that’s still available!

Products confirmed to work has been and will be updated on the driver’s wiki page. Report, questions can be posted on its Github page.

And as always, may the power of opensource be with you. Happy holidays!

Dynpick (Image source)

TORK to co-host Toyota HSR workshop for usersトヨタ HSR ユーザ向けセミナを行いました

トヨタ自動車株式会社 (以降トヨタ) 様 の生活支援ロボット “HSR”のユーザ様向け技術者セミナを,全国4箇所にて開催しました.

TORK はこれまでにも2014年の第1回,昨・2015年の第2回のハッカソン開催へのご支援を中心に HSR 開発に御協力をさせて頂いてきました.昨年までは HSR を所有するユーザが未だあまり居ない中での開催でしたが,HSR 開発者コミュニティが昨年発足し,HSR を所有する組織が拡大したのを受け,今回はそれら所有者で形成されるコミュニティのメンバー向けでした.

HSR の扱い方や ROS を用いたプログラミングといった技術的内容に加え今回は,トヨタ様の意向もあり,開発者コミュニティの積極的な利用に重きを置きました.

ユーザがネット上でグループを形成し議論する”コミュニティ”は,ROS をはじめ多くのソフトウェアのプロジェクトが汎く普及するにあたってその整備が欠かせないと言われています.HSR 用の開発コミュニティはトヨタ様が直接運営し,メンバ間での情報共有や議論に必要なツールが提供された本格的なものです.コミュニティをうまく利用することにより,御自身の開発を加速できると共に,開発者コミュニティ自体が成長し,それによって御自身の開発に更にメリットが還ってくる,という良い循環が生まれます.そうして一組織だけでなく,HSR 開発者コミュニティ全体で成果を共有し発展していくのが狙いです.

TORK has been partnering with the “HSR” welfare robot’s dev team at Toyota Motors Corporation (TMC). In 2014 and the last year 2015 we worked together with them for the hackathon.

This year we worked with TMC again to host developers workshop at 4 venues in Japan. In addition to going over the robot’s unique features and programming using ROS, we particularly focused on utilizing the online community designated for HSR owners, which TMC initiated in 2015 and maintains by themselves (membership-only as of today). Goal is that participants get hands on experience in interacting on the developers community so that they can accelerate their own development, which also contributes to develop the community size and maturity, which the developers ultimately appreciate. That said the seminar series this time is the beginning of building the communiy’s life cycle as TMC’s dev team intended.

本セミナ期間中は,プログラムを実行しても動かないだとか,実装の方法が分からないといった問題に当たったら,問題解決を自分だけで行うのではなく,コミュニティに質問し意見を伺いながら進めるよう提案しました.質問文を作成すること自体慣れないと時間が取られますし,技術者として他人に質問するのも,研究室ごとの質問に関する文化もあってか,勇気がいることでしょう.最初は中々質問が出ないこともありましたが,トヨタ様はじめ積極的な回答者の適切な回答のおかげもあり,質問するメリットを感じて頂けたかと思います.何より,セミナ実施後は実施前に比べ開発者コミュニティでの情報の流通量が大きく増えました.

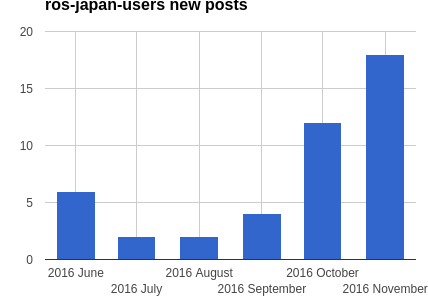

またセミナ中,HSR に依存しない問題 (ROS 一般に言える問題等) についてはそれぞれのコミュニティを利用することをお伝えし,コミュニティ例として ROS 日本語ユーザグループ “ros-japan-users” を紹介し,セミナ中に何度か試しに投稿して頂きました.その効果なのかどうか分かりませんが,セミナ開始した2016年10月以降の同グループの投稿数が下図のように一気に増えました.もし本セミナの参加者様が質問することに抵抗が減ったのであったり,セミナ無関係の方でも投稿が増えたのを見て質問する心理的障壁が少しでも下がった結果であったりするなら幸いです.

Also discussed is problem isolation – engineers often need to figure out the types of problems and post questions at the best community per incident. This is more an advanced subject, but participants well exceeded our expectation to separately post HSR-specific questions and generic-ROS questions on the forums of each. This may have resulted in the positive spike of the number of posts at the ROS Japanese user groups as you see in the graph below (workshop series started in October).

最後に幾つか,各セミナ回の最後に行ったコーディングチャレンジの動画をご紹介して終わります.HSR・ロボットコミュニティの益々の発展に微力ながら貢献できていれば何よりです.

Closing this blog post with some videos from the code challenge at the end of the workshops. We truly hope that we’ve contributed to the HSR and the world of robotics community by encouraging community involvement.

How to Ask Question質問の仕方

メール,掲示板での質問の仕方のTipsです.初心者の方は何を質問しても,「それだけだと分からない.もっと情報をください」と言われることが多いかと思います.どのように質問したらいいか?一番の目安は「困っている人のトラブルを再現できるかどうか」です.以下に例を見てみましょう.

もし,他の人も使っている汎用のプログラムだったら,

$ rviz と打ち込み,rvizを実行しました

または,

$ roslaunch urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro と打ち込みました.

など,相手も同じ問題を再現する方法が質問に含まれているか確認しましょう.

もし,自分しか使っていないプログラムの場合は,そのプログラム一式を圧縮ファイルにして質問に添付するのが簡単です.圧縮ファイルの作り方は,catkinワークスペースで

$ tar -cvzf my_package.tgz ./src

としましょう.これで生成されたmy_package.tgzを添付すればOKです.

また,添付ファイルを使えないようなメール,掲示板の場合は,ソースコード一式をGitHubにアップロードする方法もよく使われます.GitHubが初めての場合は,http://qiita.com/dev-neko/items/28ac253ea295ad6c2b73 などが参考になるでしょう.

もし,開発しているソースコードに秘密情報が入っておりアップロードすることが困難な場合は,秘密情報を抜いて一般的な問題として再定義し,そのプログラムを作ってアップロードするとと良いかと思います.また,私達のようなROS専門のコンサルタント業者にお問い合わせいただくことも可能です.

また,困っている人と同じ状況を再現するまでもなく,プログラムの出力ログを見ると原因がわかる場合も有ります.プログラムの出力ログを貼り付ける時は,自分でここは重要な箇所ではない等と判断せずに,プログラムの全ての出力を添付するのが重要です.

ROSプログラムのログの取得方法はいくつか有ります.

roslaunchを使ってプログラムを立ち上げた場合,以下のようにlogging to..というメッセージが紹介されます.

$ roslaunch urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro ... logging to /home/tork-a/.ros/log/abfd7cb2-b476-11e6-907c-e4a7a00bd84e/roslaunch-ubuntu-14449.log

このとき,/home/tork-a/.ros/log/abfd7cb2-b476-11e6-907c-e4a7a00bd84e/ にあるファイルを全て提出すれば,質問された人も何が起こっているか理解することができます.

また,最新のログファイルは常に~/.los/log/latest/ から参照できるようになっています.

上記の様にtarコマンドで圧縮ファイルを生成してもよいですし,最近はテキストファイルのアップロード場所として gist.github.com もよく利用されます.

gist が初めての場合は http://tyoshikawa1106.hatenablog.com/entry/2013/04/10/000026 などが参考になるでしょう.

他には

$ rviz 2&>1 > rviz.log

として標準出力とエラー出力の両方をリダイレクトしてファイルに書き出す方法もよく利用されます.この場合,全ての出力がファイルに書きだされ画面では見ることができないですね.teeコマンドを使うと入力を標準出力に書き出しながらファイルにも書き出します.

$ unbuffer rviz 2&>1 | tee rviz.log

unbufferを付けないと,rvizの出力がバッファされてなかなか表示されません.unbufferがインストールされていない場合は,`sudo apt-get install expect-dev` として下さい.

roslaunchはデフォルトでは各ノードの出力を標準出力には表示しません.表示したい場合は,

$ roslaunch --screen urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro

と,screenオプションをつけると良いでしょう.ログファイルを作るのは

$ roslaunch --screen urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro 2>&1 urdf.log

または,

$ unbuffer roslaunch --screen urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro 2>&1 | tee urdf.log

ですね.

大量の添付ファイルや情報を添付することに躊躇する方も多いかもしれませんが,それらの情報がなければ問題を解決できないので嫌がれることはありません.

質問する際には,相手が自分と同じ問題を再現できるか,あるいは再現しなくても状況が理解できるような十分なログを提供しているかをぜひ再確認して,質問には十分すぎる情報を添付してみましょう.

Today, we’ll show some tips on how to ask question on mailing list or message board. If you are beginner and asked question, sometimes you’re required to provide more information. So most of cases, we believe people have trouble because they do know to know how to ask question. One criteria is “Do you provide enough information that others can RE-PRODUCE your problem”. Let’s see some examples.

If you’re using general program, which someone may using. Information such as

I executed rviz program by $ rviz

Or,

I typed as follows $ roslaunch urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro

enable others reproduce your situation.

If you’re using a program that no other people is using, you can create compressed files as running following command at catkin workspace and attach your question e-mails.

$ tar -cvzf my_package.tgz ./src

If you’re asking to the mailing list or board which can not use attached file, a common way is to upload a entire source code to GitHub, if you are not familiar with GitHub, http://qiita.com/dev-neko/items/28ac253ea295ad6c2b73 may help.

If your code contains non-disclosed information and does not allow to upload on public place, you can re-define the problem without private information and upload that pgram. Or, you may ask for professional consultants as us.

Sometimes, the problem can be solved by looking at output log of the program, without re-produce the situation. In this case, it is very important not to edit your self by judging this part is important and this part is not, but to put entire log information.

To get output log of ROS program has several ways.

If you started your programs with roslaunch, you can find `logging to..` message as follows

$ roslaunch urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro ... logging to /home/tork-a/.ros/log/abfd7cb2-b476-11e6-907c-e4a7a00bd84e/roslaunch-ubuntu-14449.log

Then, if you provide all files under /home/tork-a/.ros/log/abfd7cb2-b476-11e6-907c-e4a7a00bd84e/ directory, people who questions also understand what exactly going one. You may find latest logfile from ~/.los/log/latest/

You may use tar command as we described earlier or gist.github.com is widely used recent days as a public textfile upload service.

If you haven’t used gist, you can refer http://tyoshikawa1106.hatenablog.com/entry/2013/04/10/000026

Other way is to run command like

$ rviz 2&>1 > rviz.log

to output both standard output and error to files. In this command all information is redirected to the file and no message appeared to the file. tee command will split input information into both standard output and file

$ unbuffer rviz 2&>1 | tee rviz.log

without unbuffer command, rviz output is buffered and there is delay in the message. If you do not have unbuffer command, try`sudo apt-get install expect-dev`.

sometimes roslaunch do not outputs standard output information of each node, to enable this,use –screen option as follows.

$ roslaunch --screen urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro

To create log file, you can use

$ roslaunch --screen urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro 2>&1 urdf.log

or

$ unbuffer roslaunch --screen urdf_tutorial xacrodisplay.launch model:=`rospack find pr2_description`/robots/pr2.urdf.xacro 2>&1 | tee urdf.log

Sometimes people hesitate to attach large text files or information, but without that information, we can not solve your problem. So everyone need huge information.

Whenever you ask someting, please keep in your mind that “Does other people can reproduce your program?” “Did you provide enough information that equivalent to reproduce your program” and attach enough information with your question.

ROS Workshop Schedule, from October to December 20162016年10月-12月のROSワークショップ日程

Here are the schedule of our ROS workshop series during the last three months of 2016!

Oct. 27 Thu 13:30- Introductory

Nov. 02 Wed 13:30- Introductory

Nov. 22 Tue 13:30- Introductory

Dec. 01 Thu 13:30- Introductory

Dec. 06 Tue 13:30- Introductory

Dec. 09 Fri 13:30- Introductory

Dec. 21 Wed 13:30- Introductory

Venue: Hongo, Tokyo

Inquiries: info[at]opensource-robotics.tokyo.jp

以下日程でROSワークショップを行います.

10月27日(木)13:30~ ROSワークショップ初級編

11月02日(水)13:30~ ROSワークショップ初級編

11月22日(火)13:30~ ROSワークショップ初級編

12月01日(木)13:30~ ROSワークショップ初級編

12月06日(火)13:30~ ROSワークショップ初級編

12月09日(金)13:30~ ROSワークショップ初級編

12月21日(水)13:30~ ROSワークショップ初級編

場所は都内・本郷のミーティングスペースでの実施を予定しています.

中級編についてはご要望があり次第,日程を調整いたしますのでメイルにてお問い合わせください.

お申込みは以下より詳細をご確認の上,ページ内のお申込みリンクよりエントリをお願い致します.

日程の調整,その他ご相談,企業内ワークショップ,カスタマイズワークショップも承っております.お気軽にご相談ください.

info[at]opensource-robotics.tokyo.jp

catkin-tools – our OSS contribution pt.2 catkin-tools 便利機能に貢献しました その二

Following our previous post about a nice hidden tip for catkin-tools, here’s another one.

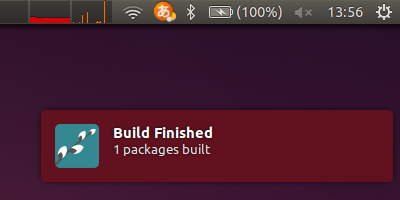

When finishes compilation, `catkin build` shows a pop-up window at the top-right on your screen (if you’re on Ubuntu Linux), which indicates `Build Finished` or `Build Failed`. This is nice in that you can work on another windows without payting attention to catkin’s progress. Caveat is, though, that “Finished” and “Failed” aren’t that obviously differentiating whatsoever.

With the newer version of catkin-tools, 0.4.3 or higher, the window pops up with a distinguishable colors; Green for success and red for failure.

This little but significantly effective change is done by our TORK associates again. The change was made swiftly and neatly as it has always been in the opensource software community.

先日ROS の非公式ビルド/コンパイルツールである catkin-tools について便利な技を紹介しましたが,今日ももうひとつ便利機能を紹介します.

`catkin build` を実行してコンパイルしたあと,ディスプレイの右上に `Build Finished` または `Build Failed` というポップアップウィンドウが表示されますね.これで,catkin-tools を実行しているターミナルで以外のウィンドウで作業していても,コンパイルが終わったことを瞬時に知ることができます.でも,これ,英語に慣れていないと,Finished (終了,正常) なのか Failed (失敗) なのかを瞬時に把握するのが難しいですよね.いや,英語に慣れていても紛らわしいですかね.

そこで catkin-tools のバージョン 0.4.3 からは,成功していたら緑色,失敗していたら赤色のアイコンが表示されるように改善されました.

ちなみにこれも TORK 関係者のプルリクエスト (変更案の提供) によるものでした.こういう小さい改良を根気よく皆で続けることがオープンソースの強みですね.

UPDATE 1/6/2017 catkin_tools 0.4.3 がやっとリリースされ,ここで取り上げている機能が使えるようになりました.記事先行してしまいお待たせしていたら失礼しました.

ROS Workshop for Intermediate Manipulation on 16th September ROSワークショップ中級・マニピュレーション編を開催しました

We had ROS Workshop for Intermediate Manipulation at Hongo, Tokyo.

The participant also joined our Beginners Workshop a few weeks ago, then re-setup her own PC, purchased robot parts and review all contents.

Thanks you for joining us!!

今回は本郷のオープンスペースにて,ROSワークショップ中級・マニピュレーション編を開催しました.

本郷のオープンスペースはコーヒーが一日中無料です!

本日の参加者の方は初級編の機材一式を購入し復習されたそうです.

長時間の講習お疲れ様でした.ありがとうございました.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップ,出張ワークショップ,カスタマイズワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

private OSS meeting on 27th September OSS座談会を開催しました

We had a prvate OSS meeting at a conference room of a company, Tokyo.

Trying to use OSS and ROS in your project, a lot of question will come out.

We can cleay answer you about the procedures and questions on using OSS and ROS.

Private workshops and other consultations are also accepted.

Please do not hesitate to contact us!

今回はある企業様の会議室をお借りしてOSS座談会を開催しました.

社内でROSやOSSを使っていくには,社内で抵抗があったり,心配事やわからないことがあるかと思います.

弊社では,OSSを使っていくにあたっての手順やご質問に,ご希望の場所にお伺いしてお答えしています.

プライベートワークショップ,その他ご相談も承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop for Beginners on 13th September ROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

One participant prepared own Ubuntu PC and installed indigo, the other used our LiveUSB.

You can experience ROS workshop by the LiveUSB without installation of Ubuntu on your machine.

Thanks you for joining us!!

今回も本郷のオープンスペースにてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

実施時間中にROSに関するお困りごとだけでなく,オープンソースを社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

出張セミナー,カスタマイズワークショップ,個別コンサルティング,プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

catkin-tools tipcatkin-tools 隠れ便利機能その一

ROS ではコンパイルを行う catkin_make という独自ツールが用意されています.CMake というソフト開発でとてもよく使われるコンパイルようツールを拡張したもので,沢山のソフトウェアパッケージを一気にコンパイルする必要も往々にして発生するロボティクスにおいて便利なツールです.一方で,遅い!だとか,コンパイル実行の度にいちいちフォルダ移動めんどい!等課題も多く指摘されており,非公式ではありますが改良版の catkin-tools というのがあります.先に述べたような根本的な問題から,痒い所に手が届く的なウレシイ機能までよく出来たツールで,人気を集めています.

使い方等は上記リンクを辿っていただくことにして,今日はまったく知られていないもののなかなか便利な機能を紹介します.

catkin_make あるいは (catkin-tools だと) catkin build を実行しコンパイルした後に,コンパイル成功したソフトの情報をターミナルに読み込ませるために次のようなコマンドを実行することになっているかとおもいます.

source ~/catkin_ws/devel/setup.bash

コンピュータ上の path を意識させないのが ROS なので,上のコマンドには違和感を感じ続けてきた方も居たのでしょうか.catkin-tools はやってくれました.まず

source `catkin locate --shell-verbs`

とすると,catkin source というコマンドがつかえるようになります (back quote に注意).このコマンドは絶対 path を意識せずに環境情報の読み込みが可能にします.例えば,

cd ~/catkin_ws/src/ros_seminar catkin source

と実行すると,上記の絶対 path コマンドと同じことをしたことになります.どのディレクトリにいても大丈夫なので,例えば次のどれでも結果は同じになります.

cd ~/catkin_ws/src/ros_seminar cd ~/catkin_ws/src/ros_seminar/rosseminar_hironx cd ~/catkin_ws/src/

便利ですね!ROS ではコンパイルを行う catkin_make という独自ツールが用意されています.CMake というソフト開発でとてもよく使われるコンパイルようツールを拡張したもので,沢山のソフトウェアパッケージを一気にコンパイルする必要も往々にして発生するロボティクスにおいて便利なツールです.一方で,遅い!だとか,コンパイル実行の度にいちいちフォルダ移動めんどい!等課題も多く指摘されており,非公式ではありますが改良版の catkin-tools というのがあります.先に述べたような根本的な問題から,痒い所に手が届く的なウレシイ機能までよく出来たツールで,人気を集めています.

使い方等は上記リンクを辿っていただくことにして,今日はまったく知られていないもののなかなか便利な機能を紹介します.

catkin_make あるいは (catkin-tools だと) catkin build を実行しコンパイルした後に,コンパイル成功したソフトの情報をターミナルに読み込ませるために次のようなコマンドを実行することになっているかとおもいます.

source ~/catkin_ws/devel/setup.bash

コンピュータ上の path を意識させないのが ROS なので,上のコマンドには違和感を感じ続けてきた方も居たのでしょうか.catkin-tools はやってくれました.まず

source `catkin locate --shell-verbs`

とすると,catkin source というコマンドがつかえるようになります.このコマンドは絶対 path を意識せずに環境情報の読み込みが可能にします.例えば,

cd ~/catkin_ws/src/ros_seminar catkin source

と実行すると,上記の絶対 path コマンドと同じことをしたことになります.どのディレクトリにいても大丈夫なので,例えば次のどれでも結果は同じになります.

cd ~/catkin_ws/src/ros_seminar cd ~/catkin_ws/src/ros_seminar/rosseminar_hironx cd ~/catkin_ws/src/

便利ですね!

ROS Workshop for Beginners on 7th September ROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

The participant prepared own Ubuntu PC and installed indigo.

You can experience ROS workshop by the LiveUSB without installation of Ubuntu on your machine.

Thanks you for joining us!!

今回も本郷のオープンスペースにてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,オープンソースを社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

出張セミナー,カスタマイズワークショップ,個別コンサルティング,プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

ROS Workshop for Beginners on 2nd September ROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

We used custom ROS-preinstalled LiveUSB, so people had ROS experience without change your PC environment.

All of attendee ran through the all topics.

Great work, everyone!!

今回も本郷のオープンスペースにてROSワークショップ初級編を開催しました.

皆さん,ご自身のPCにROSをインストールしてのご参加でした.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

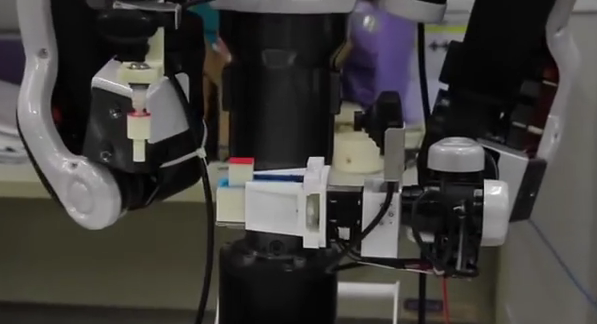

NEXTAGE Open in Singapore revisited: both hands assembly using camera imageNEXTAGE Open in シンガポールその2:画像処理と両手を使った物品組み立て

ROS が普及したことで,ロボット開発者の間である種の共通言語となりつつあると言っても過言ではありません.既に多くのロボットの可動実績があり,ユーザ数は10万人を超えるとも言われ (2015年 ROSCon より),ロボットのシステム構築において着実に情報が蓄積されており,それを元に更に益々ユーザ層が厚くなるといった良い循環ができています.

とはいえロボット毎のハードウェアの違いを基にした差異は避けられないもの.同じロボットを扱う開発者間の情報は貴重でしょう.

弊社がソフトウェアのメンテナンスを中心となって行わせて頂いている NEXTAGE Open (カワダロボティクス社) も世界中にユーザがおり,私達も情報共有に微力ながら貢献しています.NEXTAGE Open の ROS 版ソフトウェアの利用に際して,議論はメーリングリストへ,御質問は github へどうぞ.

[github-issues username=”tork-a” repository=”rtmros_nextage” limit=”10″]

表.github 上で議論中のチケット一覧

今日は,先日もお伝えしたシンガポールの Nanyang Technological University (NTU) の研究者が公開している,NEXTAGE Open の動画を紹介します.今回はカメラからの入力を元に幾つかの Pick&Place を行っているようです.今のところこれら動画中のアプリケーションソフトウェアは公開されていないようですが,御興味があれば動画サイトのコメント機能でコメントで開発者に連絡してみると良いでしょう.

One of its many achievements as ROS being used for more and more robots is that it’s becoming a common language for the robot developers. One estimate (which is actually made by the CEO at OSRF, the maintenance organization of ROS) indicates that the userbase has now well reached 100,000 at the time of 2015 ROSCon. With vast amount of userbase with accumulated information for robot system development, we’re seeing a very successful lifecycle of ROS collectively expanding more info and users.

Still, flesh side of robots – hardware – inevitably differentiates the application level of development per robot, and therefore the conversation among the users of the same robots is valuable. For NEXTAGE Open (Kawada Robotics Inc.), the one that we TORK has been actively maintaining, there are a couple of active forums: discussion can be started at mailing-list and questions at its github.

[github-issues username=”tork-a” repository=”rtmros_nextage” limit=”10″]

Table. Current issues of NEXTAGE Open ROS software on github

Today we have a few videos from researchers from NTU (Nanyang Technological University) (there was one blog post before already) in Singapore that utilize vision input for pick & place application. Code for these app are likely not yet publicized but you can contact the researchers’ group by commenting on each video on the video sharing website.

Summer Internship 2016 夏季インターンシップ始めました

We actively accept students under an intership program in respose to a request from under graduate students this summer.

Rather than group training, our internship emphasized having students experience ROS with a servo motor and learning the programming with ROS.

He study ROS for the first time this summer.

Welcome to ROS world !

大学3年生のR.S.君がTORKの夏季インターンシップに参加してくれています.

Linuxは大学に入ってから初めて触りました.

この夏,初めてROSを勉強します.

このジROS対応ロボット一覧ページでROSが使われているロボットの数を見ると皆やる気がUPしますね.

涼しい本郷のオープンスペースで暑い夏をROSの勉強で熱く過ごしましょう!

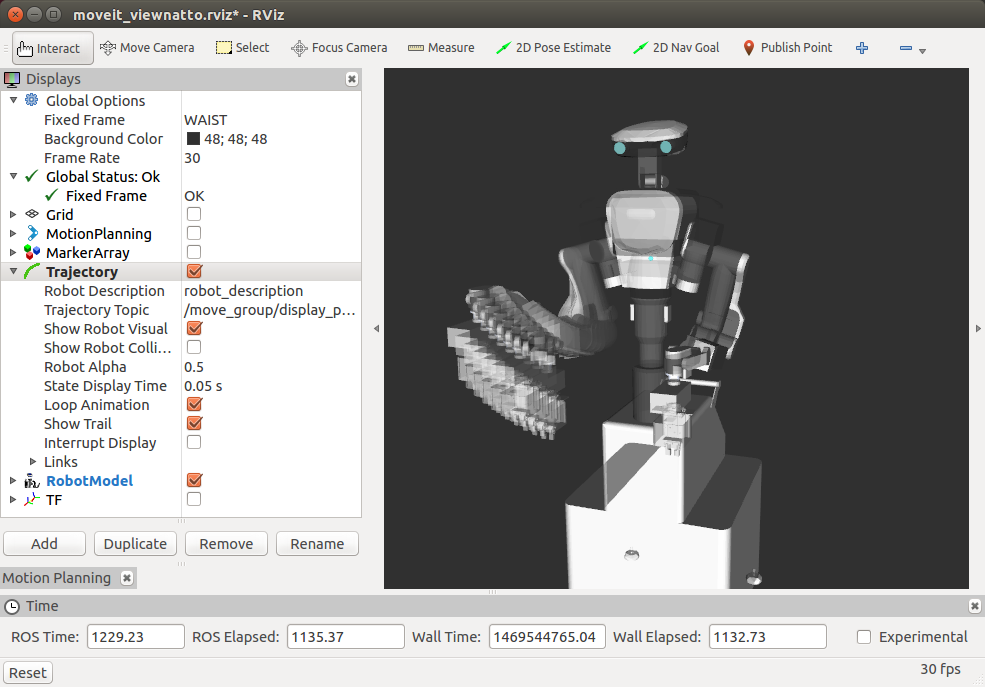

MoveItの起動プランをロボットに送る前に確認する方法 Visualize MoveIt! planned trajectory before sending to a robot

今回もまたMoveIt関連のお話です(MoveIt関連の以前の投稿は([1],[2],[3]).

実機につなげて実験している方から,moveit_commanderを利用していて計画した軌道を,ロボットに送る前にrvizで確認したい,という要望を時々尋ねられることがあります.実はこれ,ものすごく簡単にできるんです.

http://wiki.ros.org/rtmros_nextage/Tutorials/Programming_Hiro_NEXTAGE_OPEN_MOVEITで紹介しているnextage_moveit_sample.pyのプログラムで,

rarm.go()

の代わりに

import moveit_msgs.msg

plan = rarm.plan()

print("visualize plan")

display_trajectory = moveit_msgs.msg.DisplayTrajectory()

display_trajectory.trajectory_start = robot.get_current_state()

display_trajectory.trajectory.append(plan)

display_trajectory_publisher = rospy.Publisher(

'/move_group/display_planned_path',

moveit_msgs.msg.DisplayTrajectory, queue_size=10)

display_trajectory_publisher.publish(display_trajectory)

raw_input("wait for display...")

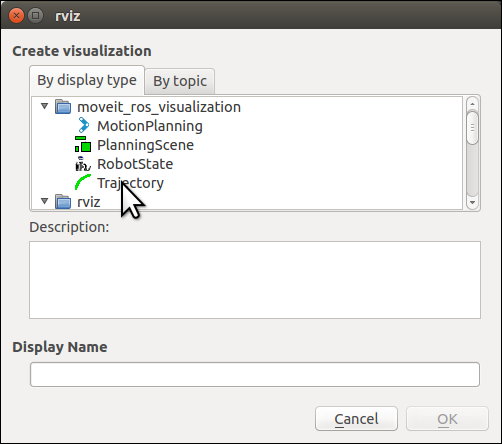

として,rvizのDisplayタブから

のようにmoveit_ros_visualization->Trajectory を追加し,

Loop AnimationとShow Trailにチェックすると以下のようにアニメーション表示することができます.

これで,安心して

rarm.execute(plan)

を実行できますね!

Today, we’ll introduce another tips for using MoveIt! (Out previous blog about MoveIt can be found at [1],[2],[3]).

We have been asked several times about a way to visualize a planned trajectory path using moveit_commander before sending to a real robot, specially those who using the system while connecting to the real robot.

And, of course, MoveIt! can do this very easily!

Looking into the sample program nextage_moveit_sample.py at

http://wiki.ros.org/rtmros_nextage/Tutorials/Programming_Hiro_NEXTAGE_OPEN_MOVEIT wiki page. First replace

rarm.go()

with

import moveit_msgs.msg

plan = rarm.plan()

print("visualize plan")

display_trajectory = moveit_msgs.msg.DisplayTrajectory()

display_trajectory.trajectory_start = robot.get_current_state()

display_trajectory.trajectory.append(plan)

display_trajectory_publisher = rospy.Publisher(

'/move_group/display_planned_path',

moveit_msgs.msg.DisplayTrajectory, queue_size=10)

display_trajectory_publisher.publish(display_trajectory)

raw_input("wait for display...")

The,

Add moveit_ros_visualization->Trajectory in the Display tab in rviz as

and add check to the Loop Animation and Show Trail displays animation as follows.

Now, you can run

rarm.execute(plan)

command without any worries.

3周年とサポート・コンサルティングサービスの実績経過TORK’s 3rd year mark and our support/consulting progress

2016年8月8日,おかげさまで TORK は設立3年を迎えました.

ロボティクス技術を使った製品開発に対する世間の関心の高まりに呼応してか,弊社としてもロボットへのオープンソースソフトウェア適用について企業様の関心の高まりを感じる一年でした.2014年度から行ってきた ROS ワークショップ (初級編,中級編等) は引き続き好評を頂き毎月開催しています.

また,創業以来続けさせて頂いているカワダロボティクス様の双腕ロボット NEXTAGE Open 用オープンソースソフトウェアのサポートサービスも順調にご利用頂いています.それに加えこの一年で,新たにロボットの種類を限定せずにお問合せに応えるチケット制コンサルティングサービスを開始し,企業様の多種多様なリクエストにより柔軟にお応えできるよう努めてまいりました.

これらのサポート・コンサルティングサービスはこの1年間で合計72回のお問合せを頂き,94%にあたる68件が解決・終了したか,或いは解法案をご提示済です.分野別では NEXTAGE Open で41件,それ以外の分野でのコンサルティングで31件頂戴しました.1年毎のお問合せ件数ですと,2015年8月時点では46.7件のペースでしたので (参考:昨年同時期の記事によると2014年1月から2015年8月までで74件の問合せ),1.5倍超のペースでお問合せ頂いていることとなります.

コンサルティングサービスの内容は,既存のオープンソースロボットに関するもの (Baxter,Turtlebot,Fetch 等),ROS のモジュールの使い方やカスタマイズ方法,自社開発への ROS 適用上のお悩み等を頂いています.カスタマイズのお問合せが転じてカスタム開発の依頼を頂くケースも出てきました.

これからも,お客様のご要望に応え,産業・学術界でのオープンソースロボティクスの進展に寄与できるよう,より一層努力して参ります.

TORK has just passed 3rd annual mark on August 8th, 2016.

Along with the global trend of robotics business and research boost, we’ve been happilly receiving interests and requests for opensource robotics technology development that we’ve contributed to and have been supporting for since our day 1 in 2013. Our ROS workshop series (beginners,intermediate etc.) are successfully running multiple times every month.

Our ticket-based support service for the dual-arm industrial robot NEXTAGE Open (Kawada Robotics) is growing its user base as well. This year round, in addition, we started opensource robotics consulting service. This new service is not restricted to a certain robot nor technology, but only limitation is “opensource robotics”, so that we can work with corporate engineers and managers for their problems regarding their robotics projects.

During the last 1 year period, we’ve received 72 tickets for total, 41 for NEXTAGE Open and the rest of 31 for other subjects. 68 tickets (94% of overall tickets) are solved/closed or possible solution is proposed to the customers. Compared to the previous year, we’re getting 1.5 times more requests (46.7 tickets/year at Aug 2015 according to the last year’s post).

Thank you all for your business with us, and understanding toward the opensource robotics.

ROS Workshop for Beginners on 3rd August ROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

We used custom ROS-preinstalled LiveUSB, so people had ROS experience without change your PC environment.

All of attendee ran through the all topics.

Great work, everyone!!

今回も本郷のオープンスペースにてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

一つ一つのタスクに対して積極的な質問をいただきながら最後まで完遂しました.お疲れ様でした!

初級編では環境の構築からセンシングデバイス,サーボの実機をROSで動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

プライベートワークショップも承っております.

お気軽にお問合せください!

info[at]opensource-robotics.tokyo.jp

How to create a page of your robot on ROS wikiROS wiki に自社/自分のロボットを掲載する方法

ROS で動くロボット,ROS が使われているロボットは一体幾つあるのですか?というのはとてもよく耳にする質問です.全貌の把握を試みるのは別な方に譲るとして,ROS の情報が一元的にまとまっている ROS wiki 上には,ROS 対応ロボット一覧ページがあります.たった今ざっと数えたところ,100種類は確実に超えていることを確認したところで,思考が停止しました.このページは手動で管理されているものなので,勿論これで全部ではないと思うと,多いですね.

このロボット一覧ページは前述の,ROS 対応しているロボットを知りたい,といったニーズに応える現状の最適な場所だと思われます.アクセス数も ROS wiki 全ページ群の中で9番目に多い (2015年7月の調査) とのことで,自社のロボットをここに掲載することはそれだけでロボット業界への効果的な告知になり得る,と考えられるのではないかと重います (ただしあくまで中立のコミュニティですから,やり過ぎな商業的告知には指摘が入る可能性もあります).

さて,ではどうやってこのページヘの自身のロボットを掲載するか.この方法が分からないという声も最近頻繁に耳にするようになりましたので,ROS wiki 上にその方法をまとめました.このページをご覧ください.

#私も自己流で編集して叱られたりコンテンツ削除されたり,時には褒められたりしながら学びました*

本件でご不明点があれば,ROS に関する質問はいつも通りの answers.ros.org か,日本語 ML でお問合せされるのが良いと思います.あと,弊社も有償でコンサルティングサービスを行っています 🙂

One of the common questions surrounding ROS is that how many robots are “ROS-compatible”? While we wait for someone else for figuring out the exact number, on ROS wiki, central source of information regarding ROS, there’s a manually-maintained list of robots that work with/on ROS. Skimming through it yields easily over 100 robots.

This listing page apprently functions as the best monolithic source of all ROSified robots as far as we are aware of, and it’s proven to work for the purpose; access rate of the page is 9th highest among all pages on ROS wiki (according to metrics in July 2015). So it makes a total sense to list your own robot on that page to get a good, effective exposure to the global robotics community (you just have to respect that the entire ROS wiki is commercial-free zone; No aggressive advertisement should take place).

Then, to answer the next common questions we’ve recently heard of, which is how we can add a list on the wiki page, we just added an instruction. Please go to this page on ROS wiki for that.

Questions regarding the instructions should go to answers.ros.org as always.

Image: Part of the robot list. Robots we (TORK) maintain the ROS packages (NEXTAGE Open, Denso etc.) are there too.

Thank you for the wonderful souvenirs ! お土産ありがとうございます!

We had a meeting with a customer at Hongo, Tokyo.

We received Ebi-sembeis as souvenirs today.

This Ebi-sembeis (shrimp cracker) is a very famous gift in Japan.

Thank you for the wonderful souvenirs !!!

ROS Seminar courses will be held in summer 2016 by TORK in Tokyo, Japan. Any inquiry can be posted at info[a-t]opensource-robotics.tokyo.jp

打ち合わせでお客様からお土産を頂きました.お気遣い頂き恐縮です.

坂角総本舗の海老煎餅です!最高です!!ありがとうございます!!!

いつも以上に仕事を頑張っております!

ROSやオープンソースに関わるコンサルティング,出張ワークショップ,カスタマイズワークショップも承っております.

詳細はWebページをご覧いただくか,メールにてお問い合わせ下さい.

info[at]opensource-robotics.tokyo.jp

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

その他,こういった企画を実施して欲しい等,TORKにやってもらいたいことのご意見ご要望もお待ちしております!

メール以外にもfacebookやtwitterアカウントもございますのでそちらにメッセージ,リプライにてご意見いただくことも可能です.

お気軽にお問い合わせください.

ROS Workshop for Beginners on 13th JulyROSワークショップ初級編を開催しました

We had ROS Workshop at Hongo, Tokyo.

We used custom ROS-preinstalled LiveUSB, so people had ROS experience without change your PC environment.

All of attendee ran through the all topics.

Great work, everyone!!

今回も本郷のオープンスペースにてROSワークショップ初級編を開催しました.

ご自分のPCでUubuntu環境が準備できなくても,LiveUSB等でワークショップを体験できます.

本日も全員が最後まで完遂しました.お疲れ様でした!

初級編ではROSの環境の構築からセンシングデバイス,サーボの実機を動かすところまで半日で習得できます.

時間中にはROSに関するお困りごとだけでなく,社内で運用していく際の疑問点等にも随時お答えしています.

ROSを初めて勉強する人へのブログも公開しています. ご参考になさってください.

ROS Workshop Schedule, from July to September 20162016年7月-9月のROSワークショップ日程

Here are the schedule of our ROS workshop series during the third three months of 2016!

Jul. 07 Thu 13:30- Introductory

Jul. 13 Wed 13:30- Introductory

Jul. 15 Fri 13:30- Introductory

Jul. 22 Fri 10:30- Intermediate

Aug. 03 Wed 13:30- Introductory

Aug. 10 Wed 13:30- Introductory

Aug. 16 Tue 13:30- Introductory

Aug. 19 Fri 10:30- Intermediate

Sept. 01 Thu 13:30- Introductory

Sept. 07 Wed 13:30- Introductory

Sept. 13 Tue 13:30- Introductory

Sept. 16 Fri 10:30- Intermediate

Sept. 27 Tue 13:30- Introductory

Sept. 29 Thu 10:30- Intermediate

Venue: Hongo, Tokyo

Inquiries: info[at]opensource-robotics.tokyo.jp

以下日程でROSワークショップを行います.

7月07日(木)13:30~ ROSワークショップ初級編

7月13日(水)13:30~ ROSワークショップ初級編

7月15日(金)13:30~ ROSワークショップ初級編

7月22日(金)10:30~ ROSワークショップ中級・マニピュレーション編

8月03日(水)13:30~ ROSワークショップ初級編

8月10日(水)13:30~ ROSワークショップ初級編

8月16日(火)13:30~ ROSワークショップ初級編

8月19日(金)10:30~ ROSワークショップ中級・マニピュレーション編

9月01日(木)13:30~ ROSワークショップ初級編

9月07日(水)13:30~ ROSワークショップ初級編

9月13日(火)13:30~ ROSワークショップ初級編

9月16日(金)10:30~ ROSワークショップ中級・マニピュレーション編

9月27日(火)13:30~ ROSワークショップ初級編

9月29日(木)10:30~ ROSワークショップ中級・マニピュレーション編

場所については都内・本郷のミーティングスペースでの実施を予定しています.

お申込みは以下より詳細をご確認の上,ページ内のお申込みリンクよりエントリをお願い致します.

ROSワークショップ初級編

ROSワークショップ中級・マニピュレーション編

日程の調整,その他ご相談,企業内ワークショップ,カスタマイズワークショップも承っております.お気軽にご相談ください.

info[at]opensource-robotics.tokyo.jp

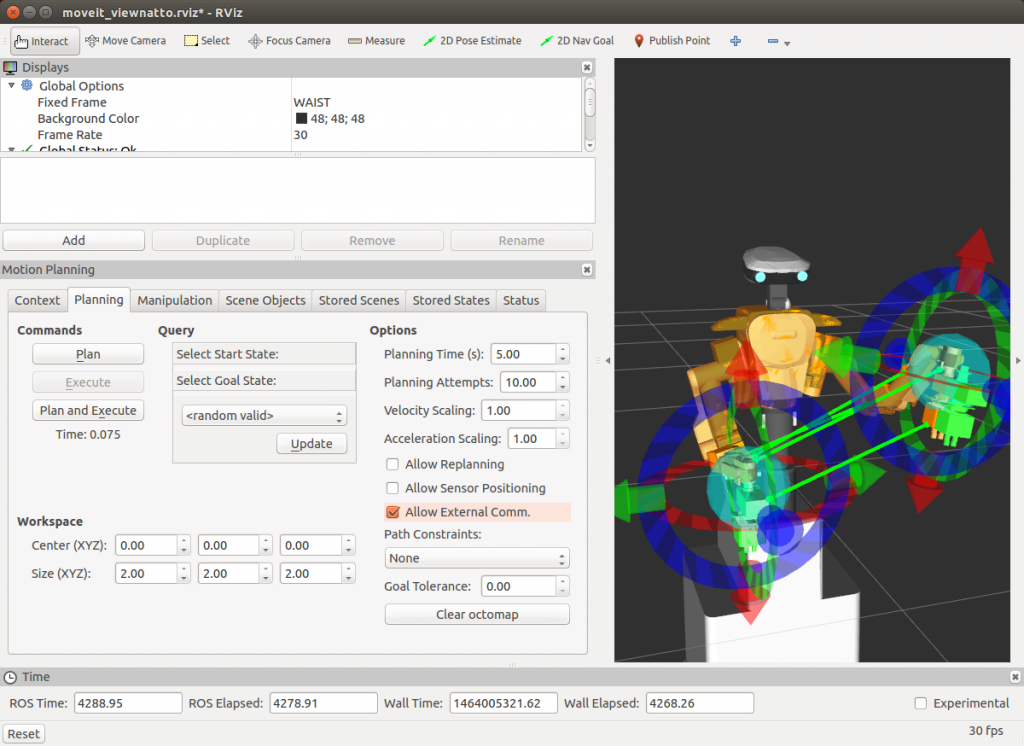

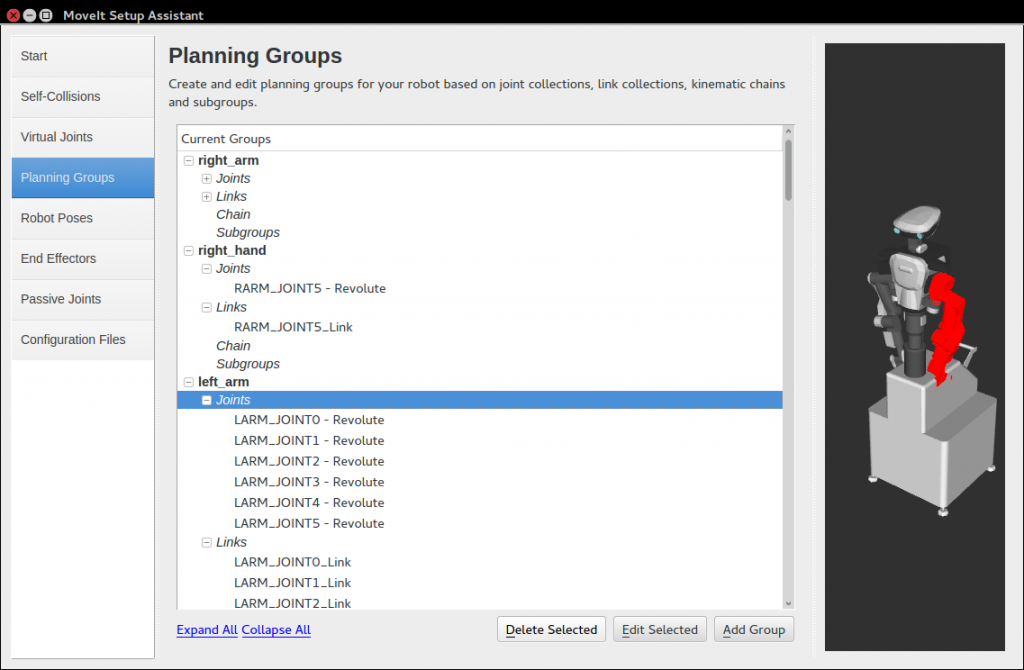

Easy Teaching Operation for NEXTAGE Open by MoveIt! JoystickMoveIt! のジョイスティック機能で NEXTAGE Open を楽々ティーチング

ROS の動作計画アプリ MoveIt! を使った開発を行っている方々の中には,MoveIt! のバイナリ提供は更新が滞ってるから仕方なくソースコードをコンパイル (そしてコンパイルエラーと格闘) して時間を費やしてしまっている方もいるのではないでしょうか.ご安心下さい.最近メンテナンスチームが刷新されソフトウェアの更新が再び活発になってきており,今年に入って既にバイナリは3回更新されました.TORK もメンテナンスに積極的に貢献しています.

当協会のブログでも最近何度か MoveIt! の利用法についてご紹介してきました ([1],[2]).今回も新機能のご紹介です.今日紹介するのはジョイスティックから MoveIt! を制御する方法です.ロボットの動作生成・実行が,今までのように Rviz 上でマウスを使うことなく,ジョイスティックで可能になりました.

使い方は簡単.ジョイスティックが刺さったマシン上で,図のように Planning タブの AllowExternalExecution にチェックをして下さい.

あとは,以下の launch ファイルを立ちあげればジョイスティックでロボットを動かすことができます.ジョイスティックのコマンド等詳細な利用方法はこちらの WEB ページをご覧ください.

<!-- https://github.com/ros-planning/moveit_setup_assistant/pull/90 -->

<launch>

<arg name="dev" default="/dev/input/js0" />

<!-- Launch joy node -->

<node pkg="joy" type="joy_node" name="joy">

<param name="dev" value="$(arg dev)" /> <!-- Customize this to match the location your joystick is plugged in on-->

<param name="deadzone" value="0.2" />

<param name="autorepeat_rate" value="40" />

<param name="coalesce_interval" value="0.025" />

</node>

<!-- Launch python interface -->

<node pkg="moveit_ros_visualization" type="moveit_joy.py" output="screen" name="moveit_joy"/>

</launch>

また,NEXTAGE Open であれば,MoveIt! が起動している状態で次のコマンドひとつ起動すればジョイスティックが有効になります (jsX の値は変えて下さい).NEXTAGE Open 用の利用法をこちらにも記載しています.

One of good news about ROS community is that the maintenance of MoveIt! got revitalized where TORK is contributing to as well. In 2016 there has already been three binary update releases so far. No more building from source if you were forced to!

We’ve mentioned about MoveIt! a few times recently ([1],[2]), so do we today again. With the version 0.7.2 (on ROS Indigo), you can operate robot arms by joystick via MoveIt!

Running the feature is as simple as joystick. On RViz on the host where the joystick is plugged, check “Planning” tab –> “AllowExternalExecution” (see the image below).

Then run a launch file, either the one in your XXXX_moveit_config package if there’s already the aforementioned launch file, or simply make a launch file with the following:

<!-- https://github.com/ros-planning/moveit_setup_assistant/pull/90 -->

<launch>

<arg name="dev" default="/dev/input/js0" />

<!-- Launch joy node -->

<node pkg="joy" type="joy_node" name="joy">

<param name="dev" value="$(arg dev)" /> <!-- Customize this to match the location your joystick is plugged in on-->

<param name="deadzone" value="0.2" />

<param name="autorepeat_rate" value="40" />

<param name="coalesce_interval" value="0.025" />

</node>

<!-- Launch python interface -->

<node pkg="moveit_ros_visualization" type="moveit_joy.py" output="screen" name="moveit_joy"/>

</launch>

For the detail follow the usage page.

To run on NEXTAGE Open, make sure MoveIt! is running then run a single command below (modify jsX). You can also refer to wiki for joystick usage for NEXTAGE Open.

roslaunch nextage_moveit_config joystick_control.launch dev:=/dev/input/js1